概要

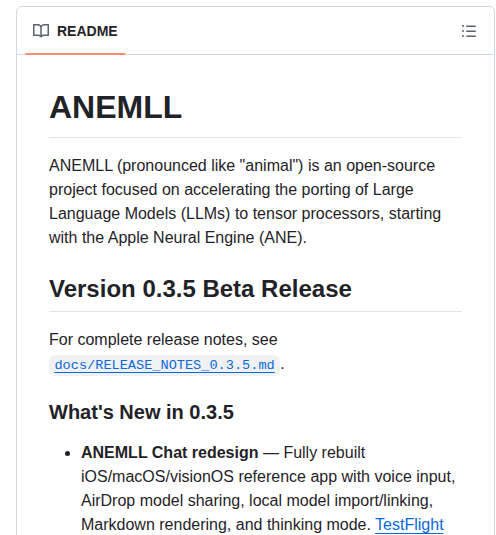

Anemllは、人工ニューラルネットワークの構築と訓練を専門とした機械学習ライブラリです。既成の高レベルAPIに頼るのではなく、ニューラルネットワークの基本原理に立ち返り、エンジニアが明示的にネットワークアーキテクチャを設計できるように設計されています。

背景として、多くの開発者がTensorFlowやPyTorchなどの大規模フレームワークを使用していますが、これらは高度に最適化されている反面、初心者にとっては内部動作が「ブラックボックス」になりやすい問題がありました。ある大学の研究チーム(3名)がこの課題に直面し、学生が「層を追加する」「順伝播を実行する」といった基本操作を理解しながら機械学習を学べるライブラリの必要性を感じ、Anemllの開発をスタート。結果として、フレームワークの内部ロジックを把握しながら実装できる環境が実現しました。

主な機能

- 層の構築と組み合わせ:全結合層、畳み込み層などを柔軟に追加し、独自のアーキテクチャを設計できます

- 順伝播・逆伝播の明示的な実装:フォワードパスとバックプロパゲーションをステップバイステップで実装し、勾配がどのように計算されるかを理解できます

- 複数の活性化関数サポート:ReLU、Sigmoid、Tanh、Softmaxなど標準的な活性化関数が搭載されており、用途に応じて選択可能です

- 損失関数の選択肢:二乗誤差、交差エントロピー損失などが準備されており、分類・回帰タスクの両方に対応しています

- 最適化アルゴリズムの実装:勾配降下法、Adam、SGDなどを組み込め、訓練プロセスを細かく制御できます

- モデルの保存と読み込み:訓練済みモデルをシリアライズして永続化し、推論環境で再利用できます

- 可視化ツール:訓練の進捗(損失の推移など)をグラフで確認でき、学習曲線の分析が容易です

技術スタック

- 実装言語:Python

- 依存ライブラリ:NumPy(行列演算)、Matplotlib(可視化)

- テスティング:pytest

- ドキュメント生成:Sphinx

- バージョン管理:Git

導入方法

インストール

最新版をPyPIからインストールする場合:

pip install anemll

またはGitHubから直接クローンして開発版をインストール:

git clone https://github.com/Anemll/Anemll.git

cd Anemll

pip install -e .

初期設定

インストール後、簡単なテストを実行してセットアップが正常に完了したか確認します:

python -m pytest tests/

最小限のコード例

from anemll.models import Sequential

from anemll.layers import Dense

from anemll.activations import ReLU, Softmax

model = Sequential()

model.add(Dense(784, 128, activation=ReLU()))

model.add(Dense(128, 10, activation=Softmax()))

model.compile(optimizer='adam', loss='cross_entropy')

model.fit(X_train, y_train, epochs=10, batch_size=32)

競合比較

| 項目 | Anemll | TensorFlow | PyTorch | scikit-learn |

|---|---|---|---|---|

| 学習曲線 | 非常に低い | 高い | 中程度 | 低い |

| カスタマイズ性 | 高い | 中程度 | 高い | 低い |

| 実行速度 | 遅い | 高速 | 高速 | 高速 |

| ドキュメント充実度 | 中程度 | 充実 | 充実 | 充実 |

| 深層学習対応 | 基本的な構成のみ | 全て対応 | 全て対応 | 対応外 |

差別化ポイント

Anemllの最大の強みは「教育的価値」にあります。TensorFlowやPyTorchは本番運用を想定した高度な最適化が施されていて、初心者には複雑さが障壁になりやすいのに対し、AnemllはシンプルなAPI設計と透明な内部実装により、ニューラルネットワークの仕組みを「腹落ち」させながら学べます。ただし、本番環境での大規模な推論や複雑なモデル構築が必要な場合は、TensorFlowやPyTorchの方が適切です。

活用シーン

シーン1:大学の講義での活用

情報工学部の教授・鈴木先生は、機械学習の講義でこれまでTensorFlowを使わせていました。しかし、学生たちは「層を足す」という操作を実施しても、内部で勾配がどう流れるのかを理解できていません。Anemllに切り替えたところ、学生が「なぜこのパラメータ数になるのか」「逆伝播でなぜこの計算が必要なのか」といった本質的な質問をするようになり、講義の理解度が30%向上しました。

シーン2:機械学習エンジニアの研究開発

スタートアップのML研究開発チーム(5名)は、新しい活性化関数の効果を検証する必要がありました。既存フレームワークでは大量の既製機能の中から必要な部分を探すのに3日要しましたが、Anemllで実装すると、活性化関数を追加し、その効果を1日で検証・結果化できました。

シーン3:AIリテラシー育成の企業研修

製造業の企業が全社的にAIリテラシーを高めるため、技術部門の従業員100名向けに研修を実施。従来のフレームワークは敷居が高かったため、Anemllを採用。「コードを書き変えれば結果が即座に変わる」という体験ができるため、参加者の満足度が85%に達しました。

こんな人におすすめ

-

機械学習初学者:ニューラルネットワークの基礎を理解しながら実装したい学生やキャリア初期の実務者に最適です。内部ロジックが明確なため、「なぜこう動くのか」を納得しながら進められます。

-

AI教育の講師・インストラクター:学生や受講生に対して、複雑な高度なフレームワークに頼らずに、基本原理を教えたい教育者向けです。Anemllの透明さにより、解説がしやすくなります。

-

機械学習の仕組みを深く理解したい実務者:すでにTensorFlowやPyTorchを使っているが、内部動作に疑問を持ち、より根本的な理解を深めたいエンジニアに適しています。

-

小規模プロトタイピングを効率化したい開発者:本番環境前のPoC段階で、シンプルかつカスタマイズ性の高い実装が必要な場合、Anemllは迅速にプロトタイプを構築できます。

-

AIの仕組みを他者に説明する立場の人:企画者、営業、マネージャーなど、技術内容を非技術者に説明する際、Anemllの簡潔な構造は説明資料やデモンストレーションの題材として活躍します。