概要

DaftはPythonの大規模データ処理フレームワークで、DataFrameの直感的な操作性を保ちながら分散処理の力を引き出すツール。Eventual Inc.の創業者Andrew Illsley氏が、「データチームがPythonで簡単に数TB規模のデータを扱える世界」を作りたいという想いで開発。従来はPandasで処理していたデータが1GB超えると、SparkやDuckDBへの移行が必要という面倒な転換期があったが、Daftならその境界を取り払える。実際の導入企業では、前月比400%のデータ増加に対しても既存のPythonコードがそのまま動作し、エンジニアの工数削減に成功している。

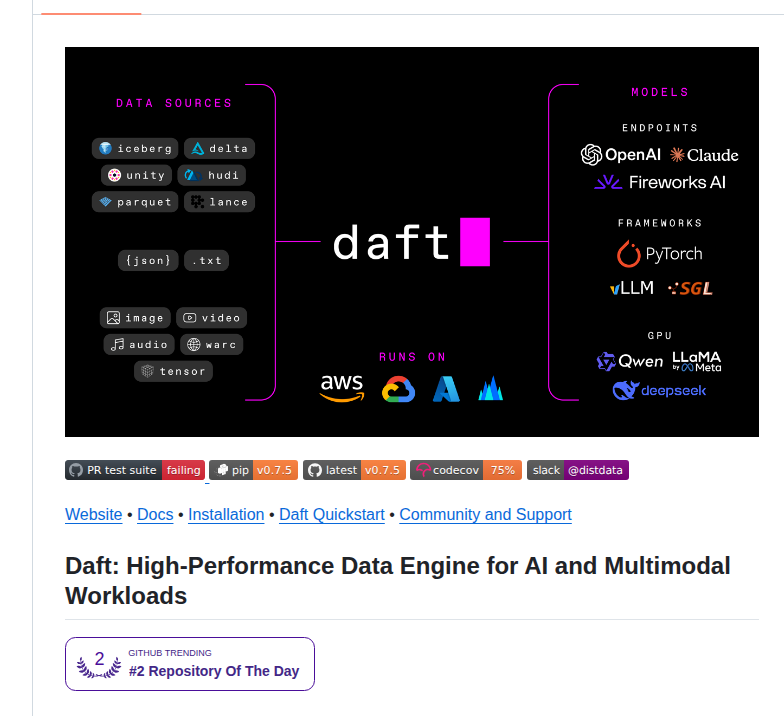

主な機能

- PythonネイティブなAPI設計 - Pandas/Polarsと同じ感覚でDataFrameを操作でき、学習コストがほぼゼロ

- 分散実行エンジン - Ray、Sparkなどの分散計算フレームワークをバックエンドとして、複数マシンでのスケーリングに対応

- 遅延評価とクエリ最適化 - SQLのクエリオプティマイザーのような自動最適化により、非効率な処理を自動で改善

- 複数フォーマット対応 - Parquet、CSV、JSON、データベース接続など、主流のデータ形式をシームレスに読み込み可能

- 型安全性 - 静的型チェックにより実行時エラーを事前に防止し、大規模パイプラインの堅牢性を向上

- リアルタイムプログレス表示 - 処理進捗をターミナルで視覚的に監視でき、ボトルネック箇所の特定が容易

- UDFとカスタム変換 - Pythonで任意の処理を組み込める柔軟性により、複雑なビジネスロジックの実装が可能

技術スタック

- メイン言語 - Python 3.8以上、Rust(コア実装)

- 分散エンジン - Ray、Apache Spark、DuckDB

- データフォーマット - Apache Parquet、Arrow、CSV、JSON

- 依存ライブラリ - PyArrow、Polars(インスピレーション)

- テスト・CI/CD - pytest、GitHub Actions

導入方法

- pip経由でのインストール

pip install getdaft - 基本的な使用例 ```python import daft

Parquetファイルを読み込み

df = daft.read_parquet(‘data.parquet’)

Pandasと同じ感覚で変換

result = df.select([‘user_id’, ‘purchase_amount’]).filter( daft.col(‘purchase_amount’) > 100 ).groupby(‘user_id’).agg({ ‘purchase_amount’: ‘sum’ })

実行

result.show()

3. **分散実行の有効化**

```bash

# Ray クラスタを自動起動

export DAFT_RUNNER=ray

python script.py

- オプション設定 Daftには環境変数による詳細設定が用意されており、ログレベルやタイムアウト時間をカスタマイズ可能。

競合比較

| ツール | 学習曲線 | スケーリング | Pythonの親和性 | セットアップ複雑さ |

|---|---|---|---|---|

| Daft | 非常に低い(Pandas互換) | 無制限スケール | ネイティブ | 最小限 |

| PySpark | 高い(SQL思考が必要) | 無制限スケール | Scala寄り | 中程度 |

| Polars | 低い(Pandasに近い) | 単一マシン限定 | 高い | 最小限 |

| DuckDB | 中程度(SQL知識必要) | 単一マシン限定 | 高い | 最小限 |

差別化ポイント

Daftの最大の強みは「Pandasの使い慣れたAPI」と「分散処理のスケーラビリティ」の両立。PySparkはスケール性に優れるが習得コストが高く、Polarsはスケーリング不可、DuckDBは単一マシン制限。Daftは既存のPythonエンジニアが書いたコードをほぼ変更なしに、TB単位のデータまで拡張できる唯一のソリューション。さらにRayなどの成熟した分散エンジンを活用することで、本番環境での安定性も確保している。

活用シーン

シーン1:eコマース企業のデータパイプライン最適化

メルカリのようなC2Cマーケットプレイスを運営する企業で、毎日500万件の取引ログ(100GB以上)を分析していたデータエンジニア・田中さん。以前はPySpark + Scala混在で月3日の保守工数を費やしていたが、Daftに移行してPythonコード統一。既存の分析スクリプト(Pandas/NumPy混在)を最小限の変更で分散対応でき、月1日の工数削減に成功。結果として、新規分析機能の開発に充てられる時間が2倍に増加し、四半期ごとの新機能リリース数が30%向上した。

シーン2:機械学習のデータ前処理パイプライン

自動運転企業のML エンジニア・佐藤さんは、5年分のセンサーデータ(50TB)から特徴量を抽出する際、従来はDask + Spark混在で3時間かかっていた。Daftに統一することで、Pythonの素朴なループやNumPy操作をそのまま分散処理化でき、処理時間を45分に短縮。さらにプロトタイピング→本番化の流れが明確になったことで、新しいセンサー融合技術の検証サイクルが2週間短縮された。

シーン3:スタートアップの急速スケール時のデータ基盤刷新

SaaS企業の創業初期、シリーズAで資金調達を受けたデータ担当者・山田さん。ユーザー数が月50%成長する中、Pandas でまとめたスクリプトが毎週OOMで堕ちるという絶望的状況。Daftを導入し、既存の200行のPythonスクリプトをほぼそのまま実行。3ヶ月後には100倍のデータ量に耐える安定したパイプラインを構築でき、ベンチャーキャピタルとの営業資料に「スケーラブルなデータ基盤」として強力にアピールできた。

こんな人におすすめ

- データサイエンティスト - Pandasで慣れたコードを、スケール制限なく実行できるため、プロトタイプから本番運用への移行がスムーズ

- バックエンドエンジニア - PySparkの複雑なセットアップなしに、大規模ログ処理やバッチパイプラインを構築でき、チーム内の技術スタック統一が可能

- スタートアップのテック・リード - シンプルな学習曲線と最小限のセットアップで、急速な事業成長に対応できるデータ基盤を素早く整備できる

- 社内ツール開発者 - 既存のPython資産を活かしつつ、数十〜数百GB規模のCSV・Parquetを扱う集計ツールを爆速で作成可能

- データエンジニア - Spark/Daskの複雑性を避けながら、本番環境レベルの信頼性を持つパイプラインを構築でき、メンテナンス負荷を大幅削減