きっかけ

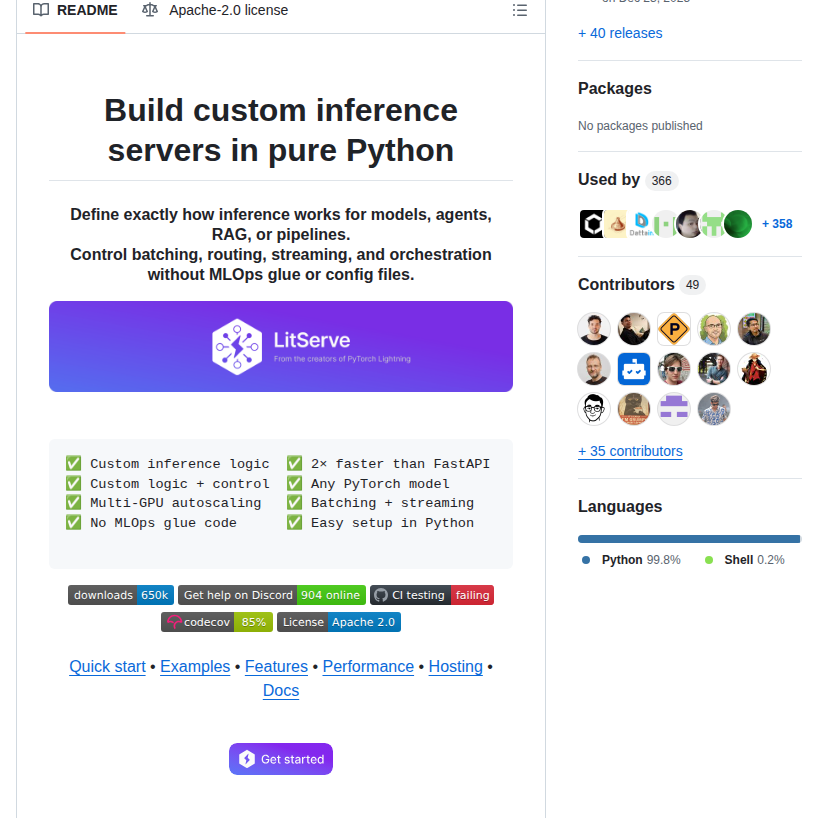

複数のLLMモデルを推論サーバーで管理する場合、それぞれを別々のプロセスで運用すると、クライアント側でのエンドポイント管理が複雑になる。そうした状況で、複数モデルを統一的に管理できるフレームワークが求められている。LitServeはそうしたニーズに応えるPythonベースの推論サーバーフレームワーク。

使ってみた

インストールは pip install litserve で完了。Pythonコードで推論ロジックを定義し、litserve run コマンドでサーバーを起動できる。FastAPIと比較して約2倍の処理速度を実現しており、推論ワークロードに特化した設計。既存のPythonコード(torch.no_grad などの推論ループ)をほぼそのまま組み込める。複数ワーカーの起動、リクエストのバッチ化、キューイングといったML運用で必要な機能が組み込まれており、カスタム実装の手間を削減できる。

ここが良い

複数モデルを一つのインターフェースで統一できる点が大きい。異なるモデルのエンドポイントを統一的なルーティングで管理でき、複数サーバープロセスの個別管理が不要になる。ヘルスチェックやエンドツーエンドのテストは標準機能として備わっている。スケーリングも簡単で、ワーカー数や並列度の調整は環境変数で対応可能。インフラ周りの管理をフレームワークに任せることで、モデルの最適化に集中できる。

気になった点

ドキュメントが整備中の部分がある。エラーハンドリングのベストプラクティスや複数モデルの条件付きロードについては、公式ドキュメントの充実が今後の課題。コミュニティはまだ発展途上段階だが、その分カスタマイズの自由度は確保されている。

まとめ

複数のLLMやカスタム推論ロジックをプロダクション環境で運用する場合、LitServeは有力な選択肢。特にマイクロサービスで複数モデルを並行運用するシステムでは、管理の複雑さを大幅に削減できる。推論サーバーの構築を効率化したい開発チームにとって、試す価値のあるフレームワーク。