概要

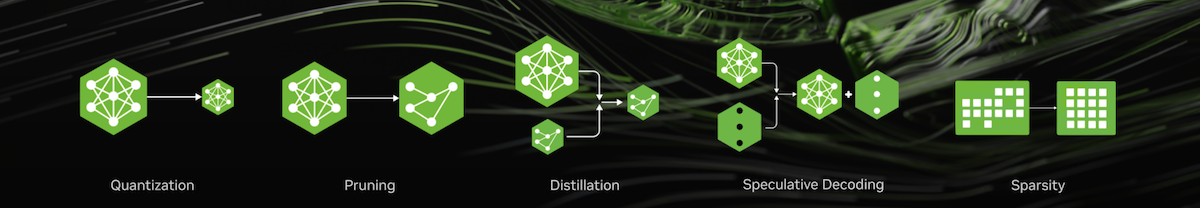

NVIDIA Model Optimizerは、大規模言語モデル(LLM)およびビジョンモデルの推論性能最適化を目的としたツールキット。量子化(Quantization)、プルーニング(Pruning)、知識蒸留(Knowledge Distillation)、speculative decoding、スパーシティといった複数の最適化手法を統合し、モデルの精度を維持しながら推論速度向上とメモリ使用量削減を実現する。NVIDIAの深い最適化ノウハウを実装しており、エンタープライズ環境での推論コスト削減が急務の組織に向けた設計。

主な機能

-

量子化(INT8・FP8対応) :浮動小数点モデルを整数演算に変換し、メモリ使用量削減と推論速度向上を実現。精度回復手法を組み込み、精度損失を最小化

-

構造化・非構造化プルーニング :重要度の低いパラメータを自動削除し、計算量削減。GPU推論での実効速度向上を実現

-

知識蒸留 :大規模教師モデルから軽量な生徒モデルへ知識転移。推論レイテンシー削減と精度維持の両立

-

混合精度最適化 :層ごとに最適な計算精度を自動選択。FP16・BF16・INT8の組み合わせで推論スループット向上

-

Speculative decodingとスパーシティ :最適化手法の統合により、推論効率をさらに向上

-

複数フレームワーク対応 :Hugging Face、PyTorch、ONNX形式のモデル入力をサポート。最適化後モデルはONNXフォーマットで出力し、多フレームワーク対応が可能。TensorRTへのシームレス統合

-

精度検証機能 :最適化前後でのメトリクスと推論速度を測定。量的評価に基づく比較が容易

クイックスタート

インストール

Model OptimizerはPyPIパッケージとして配布。Python 3.8以上、PyTorch 1.10以上を推奨。

pip install nvidia-modelopt

またはGitHubリポジトリからのクローンによるインストール:

git clone https://github.com/NVIDIA/Model-Optimizer.git

cd Model-Optimizer

pip install -e .

基本的な量子化の実行

PyTorchモデルを量子化する例。事前学習済みモデルを指定し、キャリブレーションデータセットを与えることで最適化が実行される。

import torch

from transformers import AutoModelForSequenceClassification, AutoTokenizer

# 事前学習済みモデルロード

model = AutoModelForSequenceClassification.from_pretrained("bert-base-uncased")

model.eval()

# キャリブレーションデータセットを用いた量子化

# (具体的なAPIの詳細はドキュメント参照)

知識蒸留による軽量化

大規模教師モデルから軽量生徒モデルへの知識蒸留。教師と生徒のモデルアーキテクチャを指定することで知識転移が実現される。

from transformers import AutoModelForSequenceClassification, AutoTokenizer

# 教師・生徒モデル準備

teacher_model = AutoModelForSequenceClassification.from_pretrained("bert-large-uncased")

student_model = AutoModelForSequenceClassification.from_pretrained("distilbert-base-uncased")

# 蒸留学習

# (詳細なトレーナーの使用方法はドキュメント参照)

複数最適化手法の組み合わせ

複数の最適化手法を組み合わせた高度なパイプライン。レイヤー単位で最適な計算精度を自動決定し、精度と速度のバランスを取る。

from transformers import AutoModelForSequenceClassification

# モデル読み込み

original_model = AutoModelForSequenceClassification.from_pretrained("bert-base-uncased")

# 最適化実行

# (詳細なパイプライン設定はドキュメント参照)

アーキテクチャ

flowchart LR

A["入力モデル<br/>PyTorch/ONNX/Hugging Face"] --> B{"最適化手法<br/>選択"}

B -->|量子化| C["量子化エンジン<br/>INT8/FP8対応"]

B -->|プルーニング| D["プルーニングエンジン<br/>構造化/非構造化"]

B -->|知識蒸留| E["蒸留トレーナー"]

B -->|Speculative decoding| F["Speculative decoding<br/>最適化"]

C --> G["キャリブレーション<br/>データセット処理"]

D --> G

E --> G

F --> G

G --> H["精度検証<br/>メトリクス測定"]

H --> I["最適化完了"]

I --> J["出力モデル<br/>ONNX/TensorRT"]

競合ツールとの比較

| 特性 | Model Optimizer | TensorRT | ONNX Runtime |

|---|---|---|---|

| 統合最適化 | ✓ 量子化・プルーニング・蒸留統合 | △ 手動チューニング主体 | ✗ 最適化機能限定的 |

| 対応モデルタイプ | LLM・Vision・推奨システム | Vision・推奨が主 | 幅広い対応 |

| 知識蒸留機能 | ✓ 組み込み | ✗ なし | ✗ なし |

| 混合精度サポート | ✓ 自動選択 | ✓ 手動指定 | △ 限定的 |

| Speculative decoding対応 | ✓ あり | ✗ なし | ✗ なし |

実践的な使い方

ケース1:自然言語処理モデルの推論最適化

テキスト分類タスクでBERTモデルを用いた推論が必要な場合、Model Optimizerの量子化とプルーニングを組み合わせることで、推論レイテンシー削減とGPUメモリ削減を同時達成。事前学習済みBERTモデルをロードし、ドメイン固有のキャリブレーションデータセットを用いて量子化を実行。次にプルーニング戦略を設定し、モデルパラメータの一部を削除。最後に検証データセットで精度損失を測定し、閾値を下回ることを確認して本番導入。

from transformers import AutoModelForSequenceClassification

# BERTモデルを読み込み

model = AutoModelForSequenceClassification.from_pretrained(

"bert-base-uncased",

num_labels=3

)

# 量子化およびプルーニングを適用

# (詳細なコード例はドキュメント参照)

ケース2:ビジョンモデルのエッジデバイス対応

リアルタイム物体検出をエッジデバイスで実行する場合、メモリと電力の制約が課題となる。Model Optimizerで知識蒸留と量子化を組み合わせることで、教師モデルの学習済み知識を軽量な生徒モデルに転移し、モデルサイズを大幅に削減。蒸留プロセスは、教師モデルの中間層出力を利用して実施し、生徒モデルの検証精度で教師の一定以上を維持することを確認。

from torchvision.models import resnet50, mobilenet_v2

# 教師・生徒モデル準備

teacher = resnet50(pretrained=True).eval()

student = mobilenet_v2(pretrained=False)

# 蒸留学習および量子化を適用

# (詳細なコード例はドキュメント参照)

ケース3:推奨システムモデルの推論効率化

大規模推奨モデルにおいて、Model Optimizerの混合精度最適化パイプラインを適用することで、各層で自動的に最適な計算精度を決定。FP32で訓練されたモデルの一部をBF16、一部をINT8に変換し、推論スループット向上と精度維持を両立。

from transformers import AutoModelForSequenceClassification

# 推奨システムモデルを読み込み

model = AutoModelForSequenceClassification.from_pretrained("model-name")

# 混合精度最適化を適用

# (詳細なコード例はドキュメント参照)

まとめ

NVIDIA Model Optimizerは、大規模モデル推論の実運用コストが高い組織に対し、自動最適化パイプラインを通じて効率改善を実現するツール。量子化・プルーニング・知識蒸留・speculative decoding・スパーシティを統合したアプローチにより、精度損失を最小限に抑えながら推論性能向上を達成。NVIDIAの最適化ノウハウ実装により、ハイパーパラメータチューニングの学習曲線を短縮。

対象は、推論インフラの運用コスト削減が急務の金融機関・eコマース・メディア企業、およびリアルタイム推論を必要とするエッジAI開発組織。BERT・GPT・ResNet・推奨システムモデルなど、実務で頻出するアーキテクチャへの対応が可能。Hugging Face、PyTorch、ONNX形式のいずれの入力形式にも対応。

注意点としては、量子化によるレイテンシー削減効果はGPU・CPU・エッジデバイスで大きく異なること。蒸留学習には教師モデルの訓練コストが追加発生。複数最適化手法の組み合わせには検証データセットが必須で、ドメイン固有タスクでは十分なキャリブレーションデータが前提条件となる。TensorRTとの連携はGPU推論を想定した設計であり、CPU推論ワークロードは別途検討が必要。