LLM(大規模言語モデル)

ローカルLLM実行・推論最適化・モデル比較を用途別に整理。

18件のツール・リソース

LLMをローカルで動かす・APIで提供する・最適化するためのOSSが急速に充実している。量子化・推論サーバー・モデル管理を組み合わせれば、クラウドAPIに頼らずに高性能なLLM環境を構築できる。コスト削減・プライバシー保護・レイテンシ改善など、ローカル実行のメリットは大きい。

実行環境

GPU・CPU・Apple Siliconなど対応ハードウェア

推論速度

量子化・バッチ処理・KVキャッシュで高速化

メモリ効率

GGUF・GPTQ・AWQなど量子化形式の選択

モデルサイズ

1Bから70B+まで用途に応じたサイズ選定

ローカル実行・推論最適化

LLMのローカル実行・量子化・推論サーバー構築

DFlash徹底解説|vLLM/SGLangで最大6倍高速化するブロック拡散ドラフトモデル

Z LabがリリースしたDFlashはブロック拡散モデルでドラフトトークンを並列生成する投機的デコーディング新手法。Qwen3-8BでlosslessでEAGLE-3比2.5倍・最大6倍の高速化を達成。vLLM mainline/SGLang/Transformers/MLX対応で即実用可能。

OpenOats:会議音声をローカルで転記しLLMと対話できるツール

会議音声をMac上で完全ローカル転記し、Claude・GPT-4oなどのLLMで内容を検索・対話できるOSSツール。プライバシーを守りながら議事録作成を効率化しよう。概要 OpenOatsは、会議やミーティングの音声を自動で転記し、記録された内容をAIが対話的に検索・参照できるツール。従来型の手書きメモやテキスト議…

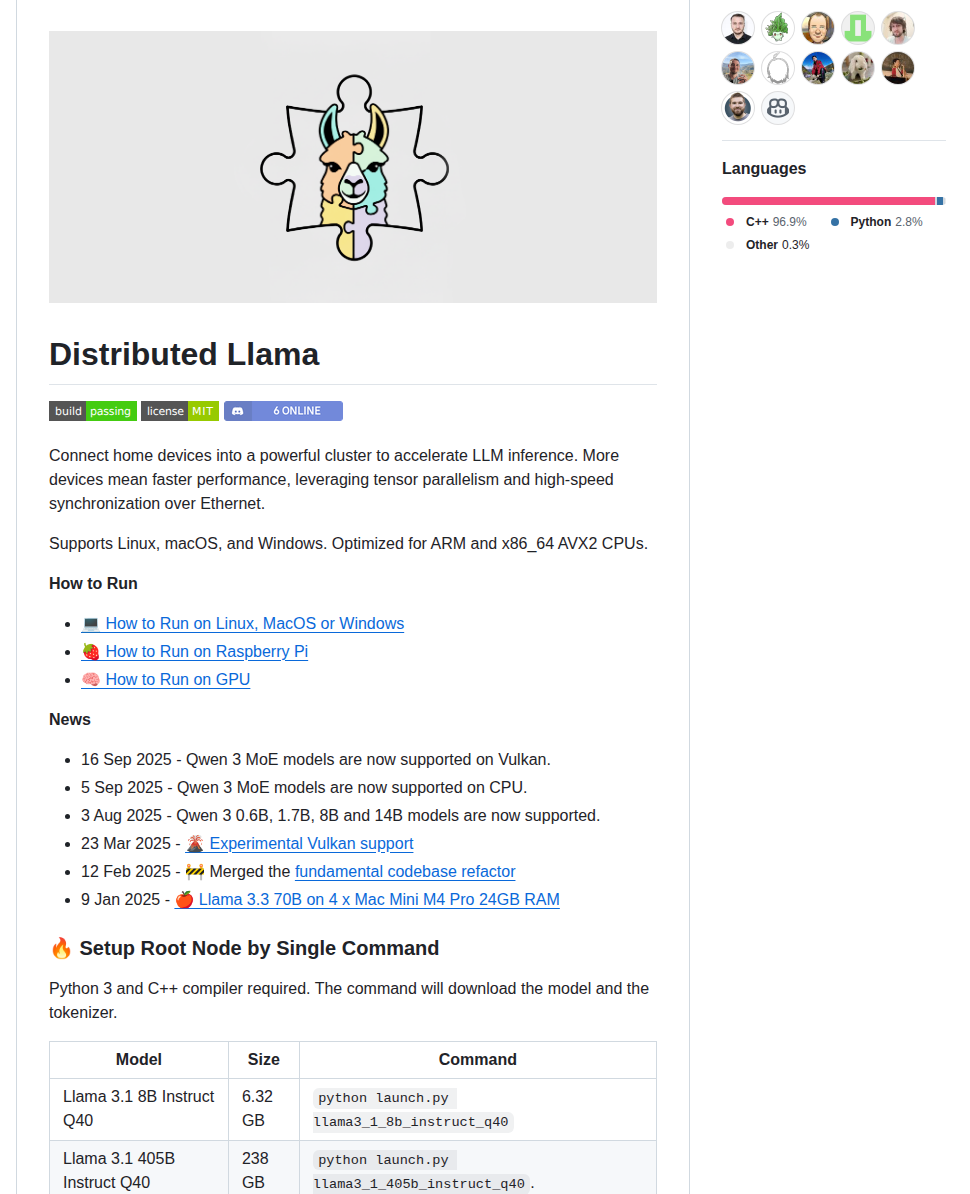

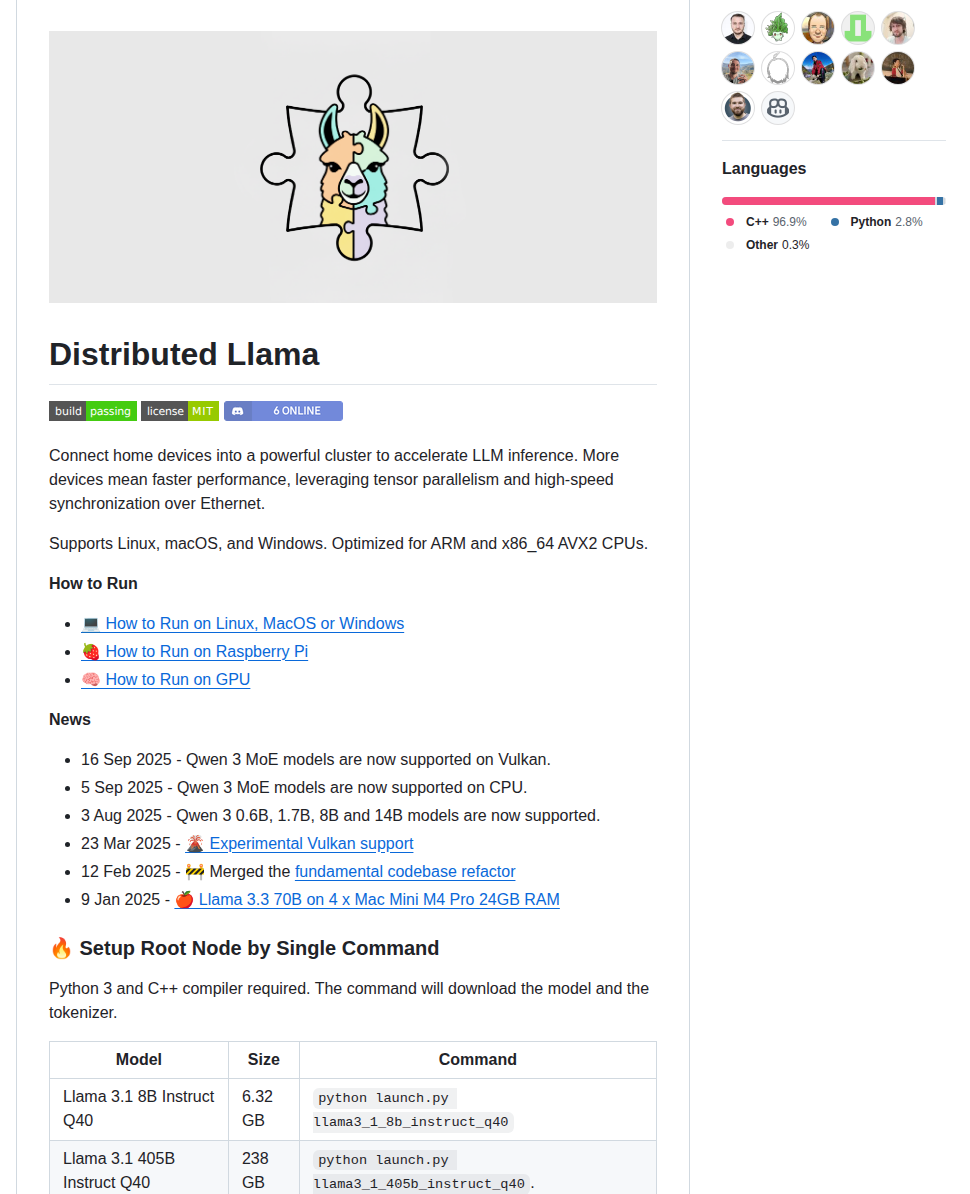

Distributed Llama:家庭用デバイスを繋ぐだけでLLMローカル実行を高速化する分散フレームワーク

家にある複数のPCやRaspberry PiをLANで繋ぎ、テンソル並列処理でLLMローカル実行を高速化するC++製フレームワーク。Llama・Qwen3・DeepSeekに対応し、月3万円のAPIコストをゼロにした実績あり。今すぐ試せるインストール手順付きで解説します。

BitNet|Microsoftの1ビットLLM量子化フレームワーク — CPUだけで100Bモデルが動く仕組み

Microsoftの1ビット量子化技術でLLMのメモリ使用量を90%削減し、エッジデバイスやスマートフォンでも高速なLLMローカル実行を実現する公式フレームワーク。CPUだけで100Bパラメータモデルが動く仕組みとインストール手順を徹底解説。

ClaraVerse:LLMローカル実行対応のプライバシー重視プライベートAIプラットフォーム完全ガイド

ClaraVerseはChatGPT・Claudeをセルフホストし、データを外部送信せずLLMローカル実行できるオープンソースプラットフォームです。マルチモーダル対応、N8N互換ワークフロー、iOS/Androidアプリを統合。Docker導入手順やコード例を詳しく解説します。

応用・統合

チャットUI・APIゲートウェイ・マルチモデルルーティング

GLM-Skills:AIエージェント向け30以上のスキルを統合公開したOSS

Zhipu AI公式のGLMスキル集がオープンソース化。画像キャプション・PDF変換・株式分析・コード生成など30以上のスキルをClaude Code・OpenCode・OpenClawから即座に利用可能。導入手順と各スキルの活用例を今すぐ確認しよう。

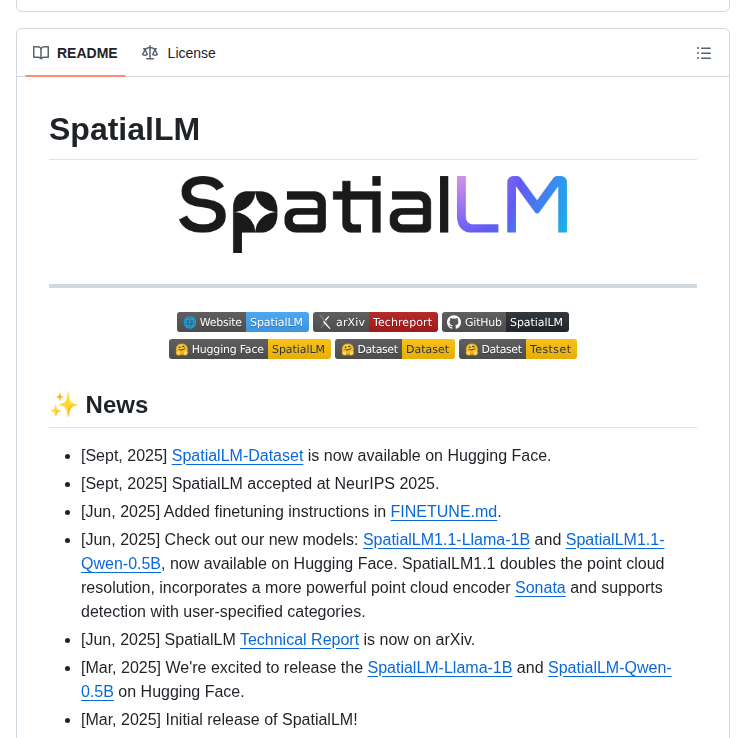

SpatialLM:空間情報を言語モデルに統合する研究フレームワーク

地理的座標や空間関係を大規模言語モデルに組み込むための研究基盤。空間推論能力を備えたAIシステムの構築を支援。GitHubで公開中、4424スター獲得。概要 SpatialLMは、大規模言語モデルに3D空間認識能力を統合するための研究フレームワーク。ポイントクラウド(点群データ)の処理と自然言語を組み合わせた空間理…

用途別おすすめ

ローカルでLLMを試したい → Ollamaでワンコマンド実行が最短。Apple Silicon Macなら特に相性が良い。「ローカル実行・推論最適化」セクションを参照。

本番APIサーバーを立てたい → vLLMのOpenAI互換APIサーバーが定番。高スループットが必要なら推論最適化ツールも併用。

複数モデルを切り替えたい → 「応用・統合」セクションのAPIゲートウェイ・ルーターで統一エンドポイントを構築。

モデルの性能を比較したい → 「モデル管理・評価」セクションのベンチマークツールで定量評価。用途に合ったモデル選定ができる。

すべてのツール

新着順に全18件を表示

PageIndex完全ガイド:Embeddingを捨てるRAGがFinanceBench 98.7%を取る

PageIndexはベクトルDBを使わず、長文PDFから階層ツリー・インデックスを構築しLLMがツリー推論で答えを引く新方式RAG。FinanceBench 98.7%精度、30k stars。CLI・Python API・MCPサーバまで導入と仕組みを徹底解説。

DFlash徹底解説|vLLM/SGLangで最大6倍高速化するブロック拡散ドラフトモデル

Z LabがリリースしたDFlashはブロック拡散モデルでドラフトトークンを並列生成する投機的デコーディング新手法。Qwen3-8BでlosslessでEAGLE-3比2.5倍・最大6倍の高速化を達成。vLLM mainline/SGLang/Transformers/MLX対応で即実用可能。

Kimi K2.6|Moonshot AIの1兆パラメータLLM — 300エージェント並列でGPT-5.4超えのコーディング性能

Moonshot AIが公開したオープンウェイトLLM「Kimi K2.6」を解説。SWE-Bench ProでGPT-5.4を上回り、300エージェント並列実行のAgent SwarmでClaude Opus 4.6と同等以上の性能を実現。APIの使い方とローカルデプロイ手順も紹介。

GLM-Skills:AIエージェント向け30以上のスキルを統合公開したOSS

Zhipu AI公式のGLMスキル集がオープンソース化。画像キャプション・PDF変換・株式分析・コード生成など30以上のスキルをClaude Code・OpenCode・OpenClawから即座に利用可能。導入手順と各スキルの活用例を今すぐ確認しよう。

ai-marketing-skills:マーケティング業務向けAIスキル習得リポジトリ

マーケティングプロフェッショナル向けのAI活用スキルセットを集約。431スター獲得の実践的リソース集で、AIツール導入と運用の知識を体系的に習得できる。概要 ai-marketing-skillsは、マーケティングおよび営業チーム向けのClaudeコード対応スキルセット。マーケティング実務で必要となるAI駆動型ワー…

SpatialLM:空間情報を言語モデルに統合する研究フレームワーク

地理的座標や空間関係を大規模言語モデルに組み込むための研究基盤。空間推論能力を備えたAIシステムの構築を支援。GitHubで公開中、4424スター獲得。概要 SpatialLMは、大規模言語モデルに3D空間認識能力を統合するための研究フレームワーク。ポイントクラウド(点群データ)の処理と自然言語を組み合わせた空間理…

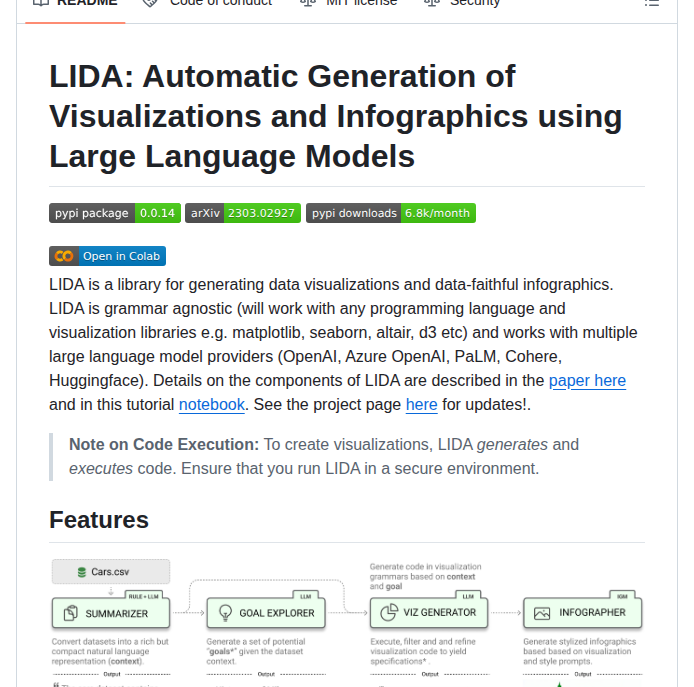

Microsoft Lida:自然言語からデータビジュアライゼーション自動生成するAIツール

テーブルデータを自然言語で指示するだけで、視覚化とグラフ生成を自動実行。データ分析の初期段階を効率化し、技術スキル不問でインサイト抽出を加速させる。GitHubで3236スター獲得の実績。

AI Reads Books:LLMがPDFを1ページずつ分析し知識を抽出

LLMがPDFを1ページずつ処理し、知識ポイントの抽出と段階的要約を自動生成するPythonツール。学術論文や技術書の読破を効率化。導入方法を紹介。概要 AI Reads Books は、複数ページのPDFドキュメントを段階的に処理し、各ページから知識ポイントを抽出しながら、指定間隔で累進的な要約を生成するツール。

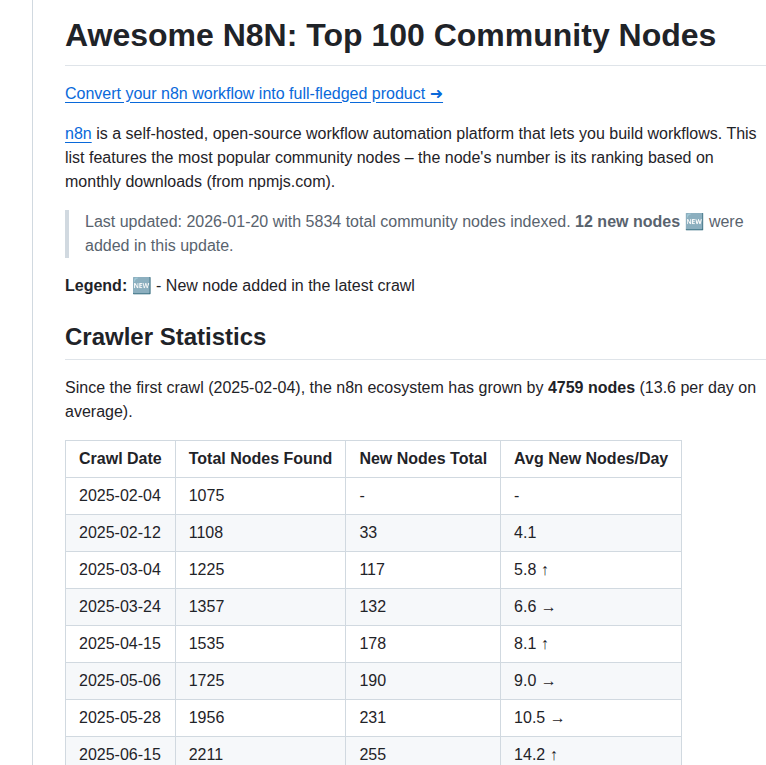

awesome-n8n - 実務的なn8nワークフローテンプレート集の活用ガイド

awesome-n8nは2800スター超のn8n向け実務ワークフローテンプレート集。通信・ドキュメント生成・AI/LLMなど複数カテゴリに整理されており、ゼロから自動化フローを設計する手間を省いてすぐ始める方法を紹介

CAI:ペネトレーションテストを自動化するAIセキュリティフレームワーク完全ガイド

CAI(Cybersecurity AI)はGitHub8,000スターのAIセキュリティフレームワーク。LLMによるペネトレーションテスト自動化・CTF解法・プロンプトインジェクション防御を解説。

Heretic:LLMのsafety alignmentを全自動除去するオープンソースツール完全解説

Hereticはトランスフォーマーベースの言語モデルからsafety alignmentを全自動で除去するツール。directional ablationとOptunaベースのパラメータ最適化で、高額な事後訓練なしに検閲解除モデルを生成できます。

AI reads books:PDFをページ単位でAI解析し知識ベースを自動構築するPythonスクリプト完全ガイド

AI reads booksは、PDFをページ単位でAIに分析させ、知識ポイントの抽出と定期的なサマリー生成を自動化するPythonスクリプト。中断からの再開機能やTOC自動スキップにも対応しています。

OpenOats:会議音声をローカルで転記しLLMと対話できるツール

会議音声をMac上で完全ローカル転記し、Claude・GPT-4oなどのLLMで内容を検索・対話できるOSSツール。プライバシーを守りながら議事録作成を効率化しよう。概要 OpenOatsは、会議やミーティングの音声を自動で転記し、記録された内容をAIが対話的に検索・参照できるツール。従来型の手書きメモやテキスト議…

MoneyPrinterV2完全ガイド:YouTube Shorts・Twitter Bot・アフィリエイトを全自動化するPythonツール【3万スター】

MoneyPrinterV2はYouTube Shorts自動生成・Twitter Bot・アフィリエイトを全自動化するPython OSS。GitHub Stars 29,600超。gpt4free+KittenTTSで動画生成からSNS投稿まで一気通貫。仕組みと導入方法を解説。

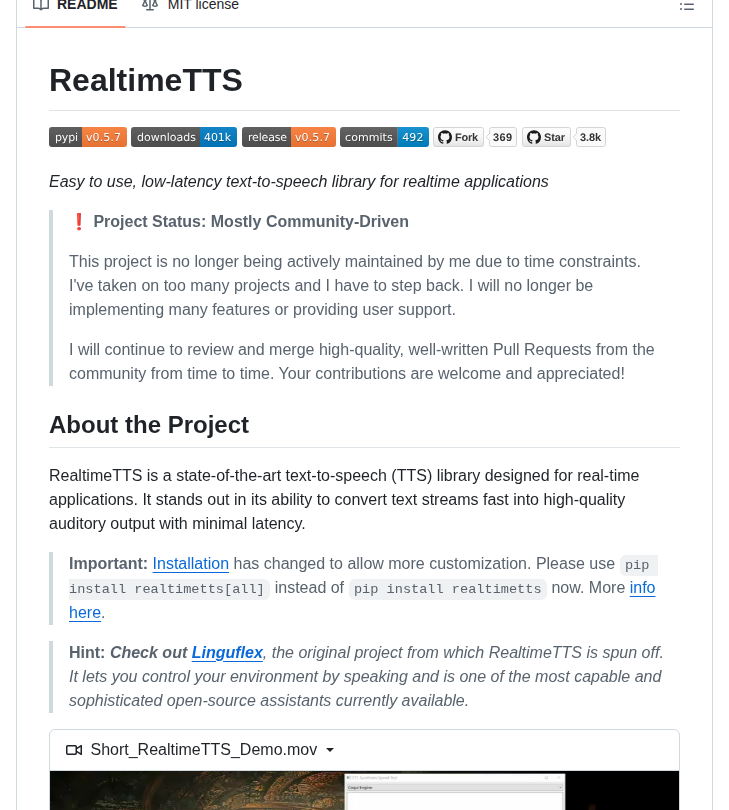

RealtimeTTS:テキスト音声変換オープンソースで実現するLLM応答のゼロ遅延音声化手法

テキスト音声変換オープンソースの決定版。LLMの最初のトークンから音声を開始するPythonライブラリで、10種以上のエンジンを統一APIで切り替え可能。AIアシスタント開発者は今すぐ導入検討を。

Distributed Llama:家庭用デバイスを繋ぐだけでLLMローカル実行を高速化する分散フレームワーク

家にある複数のPCやRaspberry PiをLANで繋ぎ、テンソル並列処理でLLMローカル実行を高速化するC++製フレームワーク。Llama・Qwen3・DeepSeekに対応し、月3万円のAPIコストをゼロにした実績あり。今すぐ試せるインストール手順付きで解説します。

BitNet|Microsoftの1ビットLLM量子化フレームワーク — CPUだけで100Bモデルが動く仕組み

Microsoftの1ビット量子化技術でLLMのメモリ使用量を90%削減し、エッジデバイスやスマートフォンでも高速なLLMローカル実行を実現する公式フレームワーク。CPUだけで100Bパラメータモデルが動く仕組みとインストール手順を徹底解説。

ClaraVerse:LLMローカル実行対応のプライバシー重視プライベートAIプラットフォーム完全ガイド

ClaraVerseはChatGPT・Claudeをセルフホストし、データを外部送信せずLLMローカル実行できるオープンソースプラットフォームです。マルチモーダル対応、N8N互換ワークフロー、iOS/Androidアプリを統合。Docker導入手順やコード例を詳しく解説します。

よくある質問

LLM(大規模言語モデル)とは?

LLM(Large Language Model)は大量のテキストデータで訓練された言語モデル。文章生成・要約・翻訳・コード生成など幅広いタスクに対応する。GPT・Claude・Llama・Gemmaなどが代表的なモデル。

ローカルLLM実行に必要なスペックは?

7Bモデルなら8GB以上のVRAM(またはRAM)、13Bモデルなら16GB以上が目安。量子化(GGUF等)を使えば必要メモリを半分以下に削減可能。Apple SiliconのMacならUnified Memoryで効率的に動作する。

vLLMとOllamaの違いは?

vLLMは高スループットの推論サーバーで、本番API提供に最適。PagedAttentionによる効率的なメモリ管理が特徴。OllamaはローカルでのLLM実行を簡単にするツールで、ワンコマンドでモデルのダウンロード・実行が可能。開発・実験ならOllama、本番運用ならvLLMが向いている。

LLMのfine-tuning(ファインチューニング)はいつ必要?

プロンプトエンジニアリングやRAGで十分な精度が出ない場合にfine-tuningを検討する。特定ドメインの専門用語・文体・フォーマットへの適応が主な用途。LoRAやQLoRAを使えば少ないリソースでも実行可能。

RAGとLLMの違いは?

LLMは訓練データに基づいて回答するため、最新情報や社内データには対応できない。RAG(検索拡張生成)はLLMに外部データ検索を組み合わせる手法で、最新情報や独自データに基づく回答を生成できる。LLMが頭脳、RAGが参考資料という関係。