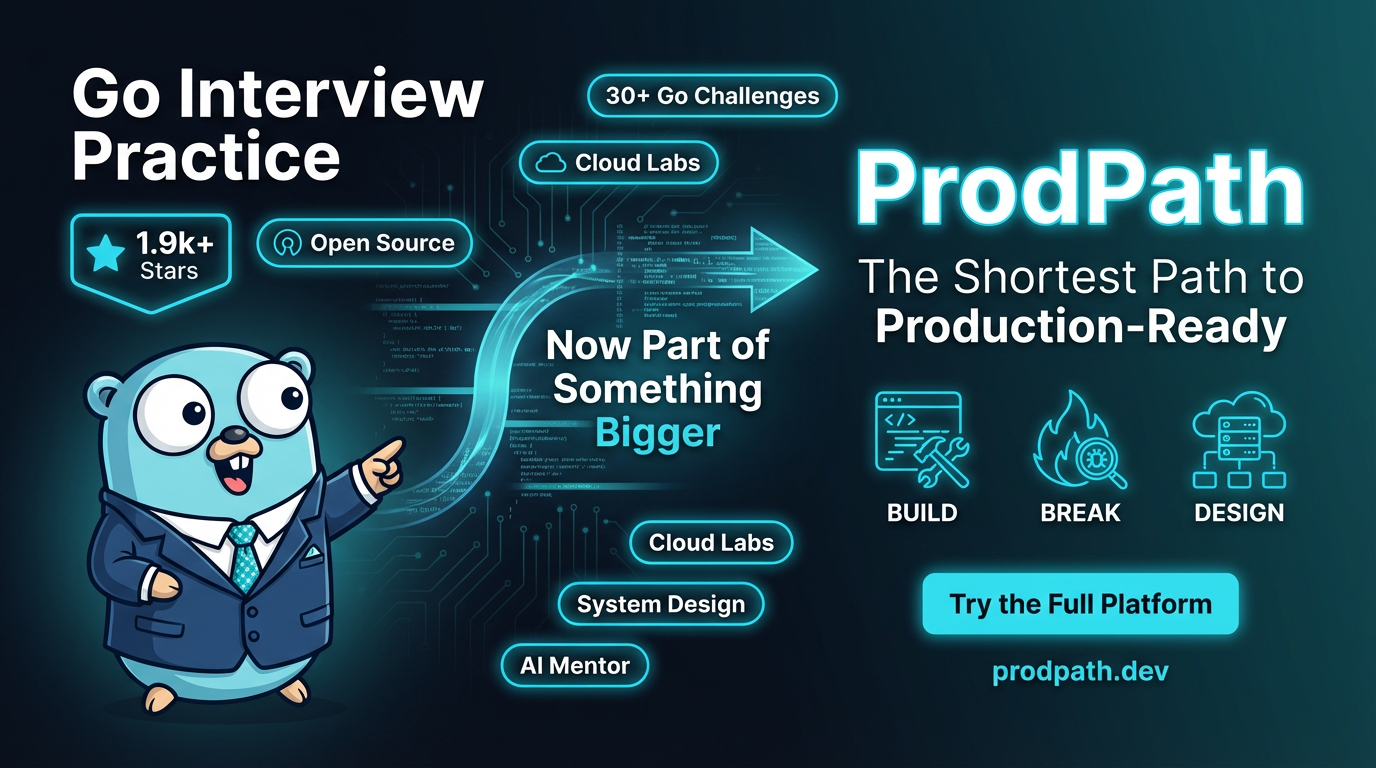

Go 面接対策をブラウザだけで完結させたい開発者にとって、go-interview-practice(RezaSi/go-interview-practice) は2026年現在もっとも実装の濃いOSS選択肢のひとつだ。30以上のコーディング課題と自動採点、gin/cobra/gorm/fiber/mongodb/echo といったパッケージ別チャレンジ、Gemini/OpenAI/ClaudeのAIメンター、ライブのスコアボードまでフル装備で、GitHubスター2,058・Fork 1,036(2026-05-04時点)と日本語圏でも参照される規模に成長している。

この記事ではgo-interview-practiceのアーキテクチャ・セットアップ手順・難易度別チャレンジ・AIインタビュー機能・他のGo学習リソースとの違いを公式README基準で整理する。AIアシスタントを活用した開発フロー全般の整理はAI自動化ツール完全ガイド2026|ノーコードからコードまで徹底比較を起点にすると俯瞰しやすい。

1. go-interview-practiceは30以上のGo課題+パッケージ別26課題を、自動採点+スコアボード付きで提供するMITライセンスのOSS

2. AI Interview SimulationはGemini/OpenAI/Claudeのいずれかを選べ、リアルタイムコードレビュー・追加質問・4段階ヒントが動く

3. Web UIはローカル/GitHub Codespaces のいずれでも30秒で起動。Forkして自分のソリューションをPRで還元するワークフローを採用

go-interview-practiceとは——ブラウザ完結のGo 面接対策プラットフォーム

go-interview-practice は、Reza Si氏(@RezaSi)が運営するGoのインタラクティブ学習プラットフォーム。READMEの冒頭は次のように位置づけている。

Master Go programming and ace your technical interviews with our interactive coding challenges.

Go 面接対策に特化しているが、実態は「Goの基礎〜応用〜パッケージ運用までを一気通貫で習熟するためのオープン学習環境」だ。2026年4月にProdPathに統合され、本家プラットフォームは app.gointerview.dev でも公開されているが、このリポジトリ自体は引き続きMITライセンスでセルフホスト可能な OSS として維持されている。

数値で見るプロジェクト規模

| 項目 | 値 |

|---|---|

| リポジトリ | RezaSi/go-interview-practice |

| 公開日 | 2025-01-14 |

| GitHubスター | 2,058 |

| Fork | 1,036 |

| 主要言語 | Go |

| ライセンス | MIT |

| クラシック課題数 | 30 |

| パッケージ別課題数 | 26(cobra・echo・fiber・gin・gorm・mongodb) |

| アクティブ開発者 | 328(Classic)/46(Package) |

Forkが1,000を超えている点は実用度の指標として重要だ。学習者が自分のリポジトリを切ってPRを送るワークフローを採用しているため、Fork数がそのまま「実際に手を動かしたユーザー数」に近い。

4つのコア機能

READMEの「Key Features」節を整理すると、go-interview-practiceの強みは次の4本柱に集約される。

- インタラクティブWeb UI:ブラウザでコード編集・テスト実行・提出まで完結

- 自動採点:テストケースを通せばスコアが上がる、シンプルで透明な評価軸

- AI Interview Simulation:Gemini/OpenAI/Claude のAPIキーを差し込めば、コードレビューと追加質問がAIから返る

- プロフィールバッジ:Markdown/SVGバッジを GitHub・LinkedIn・ポートフォリオに貼れる

特に AI Interview Simulation は、go interview practice 系のリポジトリの中でも実装が進んでいる。READMEには gemini(推奨・無料枠あり)・openai・claude のいずれかを .env で選ぶ手順まで明記されている。

30+のクラシック課題と難易度別カリキュラム——Go 面接対策の中核

go-interview-practiceが提供する課題は、Beginner/Intermediate/Advancedの3階層で整理されている。READMEに記載された全30問のカリキュラムを抜粋すると次のようになる。

| 難易度 | 課題例 | 学べる主なGo概念 |

|---|---|---|

| Beginner | Sum of Two Numbers/Reverse a String/Word Frequency Counter/Temperature Converter/Binary Search/Greedy Coin Change | 関数定義・スライス/マップ操作・基礎アルゴリズム |

| Intermediate | Concurrent Graph BFS/HTTP Authentication Middleware/Bank Account with Error Handling/SQL Database Operations/gRPC Microservices/Circuit Breaker/Slice Operations/Generics Data Structures | goroutine/channel/error wrapping/database/sql/gRPC/generics |

| Advanced | Chat Server with Channels/RESTful Book Management API/Concurrent Web Aggregator/File Processing Pipeline/OAuth2 Authentication/Dynamic Programming/Graph Shortest Path/Cache Eviction/Rate Limiter | パイプライン設計・並行制御・OAuth2フロー・アルゴリズム最適化 |

Beginnerが7問、Intermediateが13問、Advancedが10問という構成は、Go面接で実際に問われやすい問題分布と整合的だ。たとえば「Concurrent Graph BFS」「Chat Server with Channels」「Rate Limiter」のようなgoroutine/channel前提の問題は、Goエンジニアの中級〜上級面接での頻出領域そのものを反映している。

Go面接で頻出のテーマと本リポジトリのカバレッジ

Go エンジニアの中途採用で問われやすい論点を整理し、go-interview-practice のどのChallengeがどのテーマをカバーしているかをまとめておく。網羅的ではないが、面接前のセルフチェックリストとして役立つ。

並行性(goroutine/channel/sync):Goエンジニア面接の最頻出テーマ。Challenge 4(Concurrent Graph BFS)/Challenge 8(Chat Server with Channels)/Challenge 11(Concurrent Web Aggregator)/Challenge 28(Cache Implementation)/Challenge 29(Rate Limiter)が並行領域の本丸を直接扱う。「select で複数チャネルを束ねる」「context.Context でキャンセル伝搬する」「sync.Map を使うべきかを根拠付きで判断する」など、面接で深掘りされる典型問いに即答できるようになる。

エラーハンドリング設計:Goは error が値というシンプルさゆえに、設計判断の数が多い。Challenge 7(Bank Account with Error Handling)/Challenge 12(File Processing Pipeline)/Challenge 30(Context Management)が中心テーマだ。errors.Is/errors.As/fmt.Errorf("%w", err) の使い分け、カスタムエラー型をいつ作るか、リカバリ可能なエラーをどう表現するか——いずれも面接でしばしば「具体例で説明してください」と問われる。

インターフェース・ジェネリクス:Challenge 10(Polymorphic Shape Calculator)でインターフェースの基礎、Challenge 27(Go Generics Data Structures)でジェネリクスを扱う。1.18以降のGoではジェネリクス利用判断が議題になることが増えており、「ジェネリクスを使うべき/使わないべきの線引き」を自分の言葉で説明できるかが評価軸になる。

HTTP/API設計:Challenge 5(HTTP Authentication Middleware)/Challenge 9(RESTful Book Management API)/Challenge 14(gRPC Microservices)/Challenge 15(OAuth2 Authentication)が該当。ミドルウェアパターン、ステータスコード設計、認可フローなど、業務直結の論点を実装ベースで詰められる。

アルゴリズム/データ構造:Challenge 21(Binary Search)/Challenge 24(Dynamic Programming)/Challenge 25(Graph Shortest Path)/Challenge 26(Regex Text Processor)。Go特有というよりは、CSコアスキルの確認用。Big O 表記の即答と、空間/時間トレードオフの議論ができれば十分なレベル設定だ。

このマッピングを把握しておくと、自分が面接で苦手にしがちなテーマだけを重点的に潰せる。たとえば「並行は得意だがエラーハンドリングで詰まる」と自覚しているなら、Week 2のIntermediate枠でChallenge 7とChallenge 12だけ徹底的にやる、という調整ができる。

各課題に含まれる4要素

各 challenge-N/ ディレクトリには次の4要素が同梱されている。

- 問題文(Markdown)

- 関数シグネチャ(実装すべきインターフェース)

- 包括的なテストケース(

*_test.go) - 学習リソース(参考リンク・解説)

つまり、READMEを読まずに challenge-3/ を覗くだけで「何を解くべきか・どのように検証されるか・追加で何を学べるか」が一望できる構成になっている。これは新人エンジニアのオンボーディング教材としても流用しやすい設計だ。

サンプル課題で雰囲気を掴む——Challenge 1とChallenge 4の比較

Beginnerの代表 Sum of Two Numbers(Challenge 1)と、Intermediateの代表 Concurrent Graph BFS Queries(Challenge 4)を見比べると、難易度差が一目でわかる。

// Challenge 1:与えられたシグネチャに沿って実装

package challenge1

// Sum returns the sum of two integers.

func Sum(a, b int) int {

return a + b

}

これだけだと「Goのテストランナーに慣れる」程度の意味しかない。続いてChallenge 4の入り口は次のような構造だ。

// Challenge 4:並行BFSで複数クエリを処理する

package challenge4

import (

"sync"

)

// ConcurrentBFSQueries runs BFS for each start node in parallel.

// graph: 隣接リスト, queries: 開始ノード, numWorkers: ワーカー数

func ConcurrentBFSQueries(

graph map[int][]int,

queries []int,

numWorkers int,

) map[int][]int {

results := make(map[int][]int)

var mu sync.Mutex

jobs := make(chan int)

var wg sync.WaitGroup

for w := 0; w < numWorkers; w++ {

wg.Add(1)

go func() {

defer wg.Done()

for start := range jobs {

order := bfs(graph, start)

mu.Lock()

results[start] = order

mu.Unlock()

}

}()

}

for _, q := range queries {

jobs <- q

}

close(jobs)

wg.Wait()

return results

}

func bfs(graph map[int][]int, start int) []int {

visited := map[int]bool{start: true}

queue := []int{start}

order := []int{}

for len(queue) > 0 {

n := queue[0]

queue = queue[1:]

order = append(order, n)

for _, nb := range graph[n] {

if !visited[nb] {

visited[nb] = true

queue = append(queue, nb)

}

}

}

return order

}

このChallenge 4を解くだけでも goroutine/channel/sync.WaitGroup/sync.Mutex の4つを同時に扱う必要があり、Go 面接対策として頻出のテーマを一気にカバーできる。テスト側はパフォーマンス測定(メモリ/実行時間)まで自動採点してくれるため、計算量の意識が試される。

Web UIだけでなくCLIでも動く

CLIで進めたい場合は次の3コマンドで完結する。

# 1. リポジトリをForkしてClone

git clone https://github.com/yourusername/go-interview-practice.git

cd go-interview-practice

# 2. 課題ワークスペース作成

./create_submission.sh 1 # Challenge 1 のサブミッション枠を作成

# 3. テスト実行

cd challenge-1

./run_tests.sh

Web UIに依存せず go test ベースで進められるため、エディタはvim・VS Code・GoLandなど自由に選べる。CIでまとめて検証したい場合も、各 challenge-N/ 配下の run_tests.sh を呼ぶだけで結果が返ってくる。

パッケージ別チャレンジ——Gin・Cobra・GORMを実戦で学ぶ

クラシック課題と並行して提供されているのが「Package Challenges」だ。Go 面接対策の枠を超えて、業務でよく使われるOSSパッケージの実装力を測れる。

6パッケージ・26課題のラインナップ

| パッケージ | 課題数 | 主な学習テーマ |

|---|---|---|

gin |

4 | ルーティング/ミドルウェア/JSONバインディング/テスト |

cobra |

4 | サブコマンド設計/フラグ/設定ファイル/補完 |

gorm |

5 | モデル定義/関連付け/マイグレーション/トランザクション/フック |

fiber |

4 | 高速ルーティング/コンテキスト/WebSocket |

mongodb |

5 | ドキュメント設計/クエリ最適化/インデックス/集約パイプライン |

echo |

4 | バリデーション/ミドルウェア/JWT/グレースフルシャットダウン |

クラシック課題が「言語仕様+アルゴリズム」だったのに対し、Package Challengesは「フレームワーク+ライブラリのプロダクション運用」に踏み込んでいる。たとえばgormの5問にはトランザクション・フックまで含まれており、ORMの落とし穴を体系的に潰せる構成だ。

Package Challenges のスコアリング

READMEの「Package Challenges Leaderboard」には、各ユーザーが「どのパッケージで何問解いたか」がツリーマップ的に表示される。これは面接でのスキル証明としても機能する。たとえばリーダーボードに掲載されている odelbos 氏は cobra 4/fiber 4/gin 4/gorm 5 の合計17問を解いていて、これだけで「Web/CLI/ORMをカバーしている」というシグナルになる。

業務でgolang 面接を受ける側/出す側の両方にとって、「自社で使うパッケージのチャレンジ進捗」をプロフィール化できるのは実用的だ。

AI Interview Simulation——Gemini/OpenAI/Claudeを選んで実戦練習

go-interview-practiceの差別化要素として最も注目すべきは、AIメンター機能だ。.env にAPIキーを設定するだけで、コードレビュー/追加質問/4段階ヒントが動き始める。

コードを編集"] --> B["『Submit』クリック"] B --> C["go test 自動実行

(パス/フェイル判定)"] C --> D{"AI機能有効?"} D -->|YES| E["AIプロバイダ呼び出し

(Gemini/OpenAI/Claude)"] D -->|NO| F["スコア更新のみ"] E --> G["コードレビュー

(複雑度・改善案)"] E --> H["追加質問

(『この実装で

並行アクセスはどう扱う?』等)"] E --> I["4段階ヒント

(1: ナッジ → 4: 詳細解説)"] G --> J["UIに表示"] H --> J I --> J F --> K["スコアボード更新"] J --> K

推奨はGemini(無料枠あり)

READMEで明示的に推奨されているのはGoogleのGeminiだ。

echo "AI_PROVIDER=gemini" > web-ui/.env

echo "GEMINI_API_KEY=your_actual_api_key_here" >> web-ui/.env

# 取得先: https://makersuite.google.com/app/apikey

無料枠が最大級でレートリミットも緩いため、個人学習用途ではGeminiがコスパ最強になる。日本語コードレビューの精度も実用水準に達しているのは、Goの型システムとgoroutineモデルがほぼ標準的な英語ドキュメントで完結しているからだ(自然言語側で迷う余地が少ない)。

Claudeを選ぶ場合の利点

Claude(Anthropic)を選ぶ場合は、次のような特性を期待できる。

- 長文コードに対して「全体構造の妥当性」を踏まえた指摘が安定して出やすい

- 「並行性のバグ可能性」のような暗黙の前提を踏まえた追加質問の精度が高い

- Anthropic API 側のキャッシュ機構を使えば、同じコードへの追加質問でコストを下げやすい

具体的なAPI料金感はClaude料金まとめ|Claude Code・API・Opus 4.7の価格を計算シミュレーター付きで比較で計算シミュレーターを公開しているので、月あたりの想定問数から試算してみると判断しやすい。

4段階ヒントの設計が秀逸

AIが返すヒントは、READMEによれば次の4段階で組まれている。

- Subtle nudge:ヒントというより「方向感のある一言」

- Direction:着眼点を絞る(例:「

sync.WaitGroupを考えてみて」) - Specific guidance:実装パターンを示す

- Detailed explanation:完全な解説と参考実装

この設計は、教育心理学でいう Zone of Proximal Development(最近接発達領域)に沿っている。学習者が「もう少しで解ける」状態を維持し続けるよう、ヒントの粒度を段階的に上げていく構造だ。

AIプロバイダ別の体感比較

実運用で3プロバイダを切り替えてみると、得意分野が明確に分かれる。go-interview-practice 上で頻繁に呼ぶシナリオ別に、ざっくりとした傾向を整理しておく。

| シナリオ | Gemini | OpenAI | Claude |

|---|---|---|---|

| 短いコードへの一発レビュー | ◎(無料枠潤沢・速い) | ○ | ○ |

| 並行制御の暗黙バグ指摘 | ○ | ○ | ◎(前提を踏まえた指摘が安定) |

| 4段階ヒントの粒度調整 | ◎(口調が温和で初学者向け) | ○ | ○ |

| 長文コード(200行超)の構造レビュー | ○ | ◎ | ◎(プロンプトキャッシュで継続コスト低) |

| 日本語の追加質問の自然さ | ◎ | ○ | ◎ |

| API料金の予測しやすさ | ◎(無料枠) | △(短文でも従量課金) | ○(キャッシュで安定) |

「無料で始めたい」「学習用途でコストを気にしたくない」ならGemini、「並行性デバッグの精度を最重視」「同じコードを繰り返し質問する」ならClaude、「他のOpenAI連携と統一したい」ならOpenAI、という選び方になる。1つのプロバイダにロックインされない設計のおかげで、社内ポリシー変更にも柔軟に追従できる。

AI Interview Simulationを面接同等のプレッシャーで使う

学習用途と「本番想定の面接シミュレーション」は、AI機能の使い方が異なる。本番想定で使うなら、次の3点を意識したい。

- ヒントを使わない縛り:レベル1のSubtle nudgeすら見ずに完成させる。完成後にレベル4の解説と自分のコードを突き合わせて差分をレビューする

- 時間制限の自己管理:BeginnerはOpenAI o1相当でも10分以内、Intermediateは20分、Advancedは40分が目安。タイマーアプリ+Web UIの並列で計測する

- 追加質問への即答訓練:AIが投げる「この実装でメモリ使用量はO(n)以上になりますか?」のような質問に対し、間を置かず日本語+英語で答える

go コーディングテストは「コードが動く」だけでは差がつかない。動く前提で「パフォーマンス特性」「並行アクセス時の挙動」「エラーハンドリングの粒度」を即答できるかが評価軸になる。AI Interview Simulation はそこを鍛えるためのループとして秀逸だ。

セットアップ・運用・他リソースとの比較

go-interview-practiceを使うなら、最初の選択は「ローカルで動かすか/Codespacesで動かすか/既存プラットフォームを使うか」だ。

Option A:ローカルWeb UI(推奨)

# 1. リポジトリをForkしてClone

git clone https://github.com/yourusername/go-interview-practice.git

cd go-interview-practice

# 2. Web UI起動

cd web-ui

go run main.go

# 3. ブラウザで http://localhost:8080 を開く

# 4. (任意)AI機能を有効化

echo "AI_PROVIDER=gemini" > .env

echo "GEMINI_API_KEY=your_actual_api_key_here" >> .env

Go 1.19+ が入っていれば追加のセットアップは不要。READMEに「Important: You must fork this repository first before cloning」と明記されている通り、自分のソリューションをPRで還元するならFork経由が前提だ。

Option B:GitHub Codespaces

ローカル環境を汚さず即試したいなら、Codespacesが楽だ。Forkしたリポジトリの「Code」→「Codespaces」→「Create codespace on main」でクラウドVS Codeが起動し、go run main.go でWeb UIが立ち上がる。Portsタブから 8080 を Open in Browser するだけでアクセスできる。

他のGo学習リソースとの位置づけ

go interview practice 系のOSSは複数あるが、AIメンター付きで自動採点まで揃っているものは限られる。代表的な選択肢を比較すると次のようになる。

| プラットフォーム | 形態 | AI機能 | 自動採点 | 主用途 |

|---|---|---|---|---|

| go-interview-practice | OSS(Forkして自分で動かす) | あり(Gemini/OpenAI/Claude) | あり | 面接対策+実務パッケージ習熟 |

| Exercism Go Track | Webサービス/OSSメンター | あり(メンターは人間) | あり | 言語学習全般 |

| LeetCode(Go) | Webサービス | 一部AIヒント | あり | アルゴリズム面接対策 |

| Go by Example | 静的サイト | なし | なし | 言語仕様習得 |

golangci-lint チャレンジ |

Lintルール集 | なし | なし | コード品質Lint習熟 |

go-interview-practiceの差別化ポイントは「OSSとしてセルフホストしつつ、AIメンターを社内ポリシーに合わせてカスタマイズできる」点だ。社内研修用に Fork して、AI_PROVIDER を社内Claude/社内Geminiに切り替えれば、学習データを外部に出さない研修プラットフォームとしても機能する。AI 自動化ツールを業務に取り込む全体像はAI自動化ツール完全ガイド2026|ノーコードからコードまで徹底比較で整理している。

4週間ロードマップ——Go 面接対策の実戦カリキュラム

「面接まで1ヶ月」というケースを想定した、現実的な学習スケジュールを置いておく。週末に集中して取り組む前提で、平日は1日1時間ペースのつもりで読んでほしい。

Week 1:基礎の総ざらいと感覚づくり

最初の週は、Beginnerの7問(Sum of Two Numbers〜Greedy Coin Change)を1日1〜2問のペースで通す。テストランナー・スコアボード・PRワークフローという「学習ループ」に慣れることが目的なので、AIヒントは積極的に使って構わない。週末にWeb UIを使い、Beginnerの7問を再度ノーヒントで解き直してタイム計測する。これで「自分が何分で何問解けるか」のベースラインが取れる。

Week 2:並行・エラーハンドリング・generics

Intermediateの中でも頻出度が高い4問(Concurrent Graph BFS/HTTP Authentication Middleware/Bank Account with Error Handling/Generics Data Structures)を集中して解く。この週は意図的にAI Interview Simulationで「追加質問」だけを使い、自分の実装に対するツッコミに即答する練習をする。go-interview-practiceの強みである「動作するコードに対して詰められる」体験を、面接前に何度も繰り返しておくと本番のプレッシャーが下がる。

Week 3:パッケージ別チャレンジで実務感を補う

業務で使うパッケージを1〜2個選び、Package Challengesを集中攻略する。Webバックエンドのキャリアを目指すなら gin 4問+gorm 5問の合計9問が王道だ。CLIツール開発なら cobra の4問が即効性が高い。ここでは description を読みながら API ドキュメント側もブラウザで開き、「ライブラリのソースを当たる癖」を意識的につける。

Week 4:Advanced課題と模擬面接

最終週は、Advancedの中から自分が弱い領域の3〜4問(Chat Server with Channels/Rate Limiter/Cache Eviction/Dynamic Programming)を選んで攻略する。最終日にはAI Interview Simulationを「面接モード」で起動し、ヒントゼロ縛り+40分タイマーでAdvancedを1問完走する。完走後にレベル4の解説と自分のコードを突き合わせ、改善余地をメモするだけで、次の本番面接で詰まる確率が大きく下がる。

このロードマップに沿うと、おおむね30問中20問前後を実戦投入できるレベルまで持ち上がる。ProdPath側の本家アプリ(app.gointerview.dev)には進捗バッジが表示されるため、可視化したい場合はそちらでも同じ課題を進めると効果的だ。

社内研修・採用に組み込むときのチェックリスト

go-interview-practiceを社内に持ち込むなら、次の5点を最初に決めておくと運用が安定する。

- 採点軸:自動テスト合格=合格とするか、AIレビュー結果をどこまで重視するか

- 時間制限:オンライン面接の現場でどのChallenge を何分で解かせるか(Beginnerは10分/Intermediateは20〜30分が目安)

- AIプロバイダ:受験者の入力をどのプロバイダに送るかをポリシーとして明文化

- データ保持:AIプロバイダの利用規約と社内のデータ保持ポリシーが噛み合うか

- Fork運用:受験者にForkさせるのか、組織側で枠を提供するのか

採点に AI を組み込む場合は、評価のばらつきを抑えるために「AIは指摘内容のチェックリストとして使い、最終判断は人間」が定番だ。Cloudパイプライン全般のコスト感はInfracost活用ガイド:Terraformのクラウドコストをデプロイ前に可視化するOSSツール完全解説が参考になる。

まとめとFAQ——go interview practice を活かす次の一手

go-interview-practiceは、Goの面接対策をOSSの土台で進めたい開発者・採用担当・教育担当者の全員にとって、現実的な第一候補になっている。30+のクラシック課題と26のパッケージ別課題、AI Interview Simulation、自動採点、スコアボード、プロフィールバッジが揃った状態で MIT ライセンスというのは破格だ。

特筆すべきは、本家アプリ(ProdPath統合)とOSS版が並走している点だ。OSS版は社内ポリシーに合わせてセルフホストでき、本家アプリは共有スコアボードとAIメンターを即座に試せる。両者の使い分けが明確なため、「まず本家アプリで触ってからリポジトリをForkして社内に持ち込む」という段階的導入もしやすい。

最初の1週間で次のステップを踏むと、価値を最大化しやすい。

- リポジトリをForkしてWeb UIを起動、Beginner 7問を一気に通す

.envにGemini APIキーを設定し、Intermediate 1〜2問でAI Interview Simulation を体験- 実務で使うパッケージ(gin/gorm など)の Package Challenges を1パッケージ単位で集中攻略

- 自分のソリューションをPRで本家に還元し、プロフィールバッジを取得

- 社内研修用にForkして

AI_PROVIDERを社内ポリシーに合わせて切り替える

データパイプライン文脈で「自動化基盤+研修導線」を組みたい場合は、Kestra:データパイプラインとワークフロー自動化のオープンソースプラットフォームのようなワークフロー基盤と組み合わせて、定例テスト→Slack 通知→Geminiコードレビューを定期実行する構成も視野に入る。

学習者として go-interview-practice をフル活用するなら、最後に押さえておきたいのは「自分の弱点を客観的にトラッキングする」ことだ。Web UIのスコアボード履歴・AIレビューの履歴・プロフィールバッジの推移を毎週末に振り返り、改善している領域と停滞している領域を可視化する。停滞しているテーマ(並行制御・generics・gRPCなど)が見えたら、対応するChallengeを再挑戦したり、関連するOSSの実装(Goの標準ライブラリ・Kubernetes・Cockroach DB等)のソースを読んだりして、知識の幅を広げていく。go interview practiceで身についた手応えは、業務上のコード設計力にも転用できる。

Q1. プロプライエタリな採用面接で使っても問題ありませんか?

A. リポジトリ全体がMITライセンスなので、商用利用・改変・再配布のいずれも許容される。ただしAIプロバイダ(Gemini/OpenAI/Claude)の利用規約は別途確認が必要だ。受験者のコードを送信することになるため、社内コンプライアンスとAPI提供元の規約を突き合わせて運用ポリシーを文書化しておくのが安全だ。

Q2. AI機能を使わない構成でも価値はありますか?

A. 十分にある。30+ のクラシック課題と26のパッケージ別課題は、それ単体でgolang 面接の頻出領域を網羅している。go test ベースの自動採点とスコアボードだけでも、進捗管理と指導の起点として機能する。AIメンターは「あれば加速、なくても基本機能は動く」設計だ。

Q3. 既存のApp(app.gointerview.dev)との関係は?

A. 本家アプリは ProdPath 統合の Web プラットフォーム、リポジトリはOSSのセルフホスト版という位置づけだ。チャレンジ内容の本体はリポジトリ側にあり、本家アプリはそれをホスティングして共有スコアボードと統合認証を提供する。社内利用ならリポジトリ版、公開コミュニティで戦うなら本家アプリ、という選択軸になる。

Q4. 課題追加のコントリビュートはどうすれば?

A. READMEの「Contributing」節に2方向の貢献パスが用意されている。1つは既存課題のソリューションをPRで送るパターン、もう1つは新規課題を追加するパターンだ。新規課題は Classic(言語仕様+アルゴリズム)/Package(Gin/GORM等のフレームワーク)の2分類で、CONTRIBUTING.md のテンプレートに沿って challenge-N/ ディレクトリ一式を作成する。

Q5. Goの基礎が不安です。先に学ぶべきリソースは?

A. 公式のA Tour of Goと『The Go Programming Language』(Donovan/Kernighan)でgoroutine/channel/インターフェースの基礎を押さえてから入ると、Beginner 7問を1〜2時間で抜けられる。Intermediateで詰まった場合は、AI Interview Simulationの「4段階ヒント」を活用すると、独学でも止まりにくい。Go コーディングテストの試行錯誤を可視化するために、自分の解いた課題を git log --grep で振り返るのも効く。

Q6. プロフィールバッジは何ができますか?

A. 課題を解いて本家にPRがマージされると、badges/ 配下にユーザー名でSVGバッジが自動生成される。GitHub README/LinkedIn/個人ポートフォリオに貼ると、「クラシック何問/パッケージ別何問」を客観的に提示できる。READMEに掲載されている例ではFull/Compactの2形式が用意され、サイズに応じて選べる。採用面接では「何を解いたか」をリポジトリリンクで示せるのが強みだ。

Q7. AIの応答に納得できないときはどうすれば?

A. AIメンターのレビュー結果は、あくまで第二意見として扱うのが安全だ。納得できない場合は、(1) 自分のコードに対する標準ライブラリのドキュメントを読み直す、(2) Goコミュニティ(Goフォーラム・r/golang・Goのスタックオーバーフロー)で確認する、(3) 別プロバイダ(GeminiとClaudeを切り替えるなど)の応答を比較する、という3段構えが現実的だ。AIの誤りに気付けるレベルまで自分の理解を引き上げる、という意識で使うと、AI Interview Simulationの価値は最大化される。

編集部の評価メモ

go-interview-practiceを実際に触って感じた強みと弱みを、忌憚なくまとめておく。

強み:1つ目は、テストランナー+スコアボード+AIメンター+PRワークフローを一気通貫で揃えた点。学習プラットフォームとしては完成度が高く、「動けば良い」ではなく「設計について追加質問される」のはGo面接の現場感に近い。2つ目は、Package Challengesがあることで「フレームワーク/ライブラリの実務感」を試せる点。これは LeetCode 系では再現しにくい価値だ。

弱み:日本語UIは未対応で、課題説明とAIプロバイダ応答の言語は現状ほぼ英語に依存する。日本語話者でも実用上は問題ないレベルだが、英語に苦手意識のある学習者には初期摩擦になる。また、Advanced課題の難易度のばらつきがやや大きく、Cache Implementation のような重量級と Binary Search のような軽量問題が並ぶため、自分のレベルに合わせた選別が必要だ。

総合すると、Go 面接対策のOSSとしては現状ベストに近い選択肢だ。AIプロバイダの選択肢が3社用意されている点と、Package Challengesで業務に直結するスキルを試せる点は、他のOSSではほぼ代替不能な価値になっている。