AI搭載IDEを使っていて、「コードベースが大きくなるほどAIの回答精度が落ちる」と感じたことはないだろうか。CLAUDE.mdに何千行ものドキュメントを書いても、エージェントは大部分を忘れてしまう。Antigravity Workspace Templateは、この構造的な課題をマルチエージェントクラスタで解決するOSSだ。GitHubスター数は1,100を超え、Python製のエンジンが8種類のAI IDEに対応する。

この記事ではAIエージェントに特化して解説します。AIエージェント全般は AIエージェントフレームワーク比較2026年版 をご覧ください。

Antigravityが解決する「コンテキスト品質」の問題

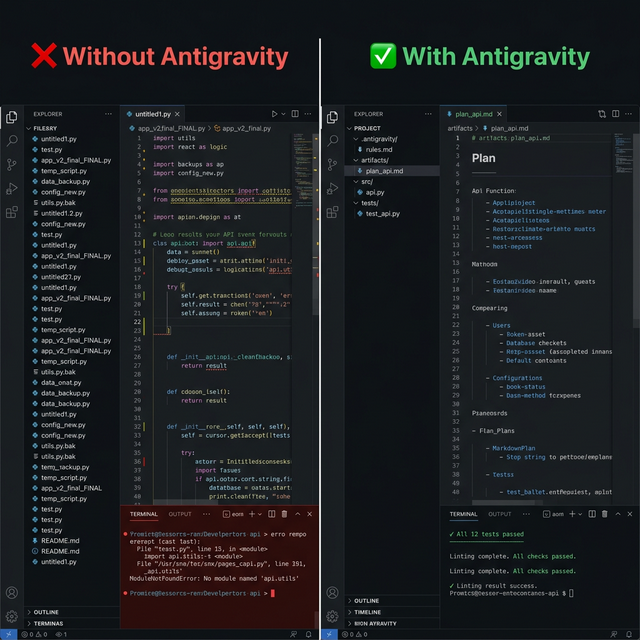

AI IDEの能力上限は「読めるコンテキストの品質」で決まる。従来のアプローチでは、CLAUDE.mdやREADMEに数千行のドキュメントを詰め込み、エージェントにすべてを読ませていた。しかしプロジェクトが大きくなるほど、重要な情報が埋もれ、ハルシネーション(幻覚)が増えていく。

Antigravityのアプローチは根本的に異なる。コードベースの各モジュールに専用のエージェント(ModuleAgent)を配置し、それぞれがソースコードを直接分析して構造化された知識ドキュメントを生成する。ユーザーの質問はRouterが解析し、最適なModuleAgentに自動ルーティングされる。

「LLMにコード全体を読ませるのをやめ、モジュール単位の専門家エージェントに分割する。Antigravityの設計思想はこの一点に尽きる」

コンテキストを「大きな一塊のテキスト」ではなく「構造化された知識グラフ」として扱う点が、従来のAIコーディング支援との決定的な違いだ。モジュール単位で責任範囲を区切ることで、Routerは「どのエージェントが答えるべきか」を精度高く判断できる。結果として、ファイルパスと行番号付きの正確な回答が返ってくる。

| 課題 | 従来のアプローチ | Antigravityのアプローチ |

|---|---|---|

| コーディング規約の忘却 | 毎回同じ修正を繰り返す | .antigravity/conventions.mdを参照し初回から正確 |

| 新規コードベースの理解 | エージェントがアーキテクチャを推測 | ag-refreshでModuleAgentが各モジュールを自律学習 |

| IDE間のルール不統一 | IDE毎に設定が分散 | .antigravity/フォルダで全IDE共通化 |

| 「Xはどう動く?」の質問 | ランダムにファイルを読む | Routerが責任モジュールのAgentにルーティング |

OpenHandsのようなAIコーディングエージェントが「コードを書く」ツールなら、Antigravityは「コードベースを理解させる」基盤と言える。実装フェーズの前に、まず正確な地図を作るレイヤーだ。

AI IDEの性能は「読めるコンテキストの品質」で決まる

Antigravityはモジュール単位のエージェントクラスタで知識を構造化する

従来の「大量ドキュメント詰め込み」とは根本的にアプローチが異なる

セットアップとクイックスタート

Antigravityは、CLI(agコマンド)とEngine(ag-refresh/ag-ask/ag-mcp)の2パッケージ構成になっている。テンプレート注入だけならCLIのみで完結し、マルチエージェントの自律学習を使う場合はEngineも追加する。

# CLIとエンジンをインストール

pip install "git+https://github.com/study8677/antigravity-workspace-template.git#subdirectory=cli"

pip install "git+https://github.com/study8677/antigravity-workspace-template.git#subdirectory=engine"

# プロジェクトに認知アーキテクチャを注入

ag init my-project && cd my-project

ag initを実行すると、以下のファイルが自動生成される。

AGENTS.md— 全IDE共通のルールブック.cursorrules/CLAUDE.md/.windsurfrules/.clinerules— IDE別のブートストラップファイル.github/copilot-instructions.md— VS Code + Copilot用.antigravity/— 動的コンテキストファイル群(conventions、decisions、module_registryなど)

「ファイルを置くだけ」で8種のIDEが同じルールを共有できるのがAntigravityの肝だ。プラグインではなくファイルベースの設計だから、IDEが新しく登場しても対応コストが低い。

次に.envでLLM接続を設定し、ナレッジベースを構築する。

# .envにOpenAI互換APIを設定

cat > .env <<EOF

OPENAI_BASE_URL=https://your-endpoint/v1

OPENAI_API_KEY=your-key

OPENAI_MODEL=your-model

AG_ASK_TIMEOUT_SECONDS=120

EOF

# ナレッジベース構築(ModuleAgentが各モジュールを自律学習)

ag-refresh --workspace .

# コードベースに質問

ag-ask "認証フローはどう動いている?"

OpenAI、Gemini、Ollama、vLLM、Groq、MiniMaxなど、OpenAI互換APIに対応する任意のプロバイダーで動作する。ベンダーロックインはない。ローカルLLM(Ollama等)を使えば、機密コードを外部に出さずに運用することも可能だ。

まずは小さめのリポジトリ(数百ファイル程度)で

ag-refreshを試すこと。大規模リポジトリでいきなり実行するとLLM APIコストが跳ね上がる可能性がある。

--quickオプションを使えば差分のみ更新でき、継続運用のコストを抑えられる。

CLIとEngineの2パッケージ構成で、用途に応じて使い分けられる

ag initで8種IDE向けの設定ファイルを一括生成するOpenAI互換APIに対応し、ローカルLLMを含む任意のプロバイダーが使える

マルチエージェントクラスタのアーキテクチャ

Antigravityの中核はag-refresh(ナレッジ構築パイプライン)とag-ask(質問応答パイプライン)の2つのフローだ。それぞれを図解で整理する。

言語・FW・構造を検出"] --> B["2. スマートグルーピング

import関係+ディレクトリで分類"] B --> C["3. ModuleAgent並列実行

各モジュール~30Kトークン分析"] C --> D["4. 構造化JSON出力

claims + evidence spans"] D --> E["5. RegistryAgent

module_registry.md生成"] end subgraph "ag-ask(質問応答)" F["ユーザーの質問"] --> G["Router

registryから責任モジュール特定"] G --> H["ModuleAgent

ソースコード検証+回答"] G --> I["GitAgent

変更履歴分析"] end E -.-> G

ag-refreshの8ステップパイプラインでは、ファイルをimportグラフ・ディレクトリ・ファイル名プレフィックスで機能的にグルーピングする。各Sub-Agentはソースコードを直接コンテキストにプリロードし(ツールコール不要)、構造化JSONクレーム(ファイルパス+行範囲のエビデンス付き)を出力する。RegistryAgentが全モジュールの意味的な要約をmodule_registry.mdにまとめ、Routerはこれを読んで質問を適切なAgentにルーティングする。

「エージェントは読むだけでなく、読んだ内容に対して構造化された根拠を残す。これがハルシネーション対策の本丸だ」

エビデンススパン(ファイルパス+行範囲)付きの構造化クレームを残す設計こそが、Antigravityの信頼性を支える中核だ。回答の各主張には「どのファイルの何行目に書かれているか」が紐付いており、ユーザーは引用箇所をIDEで直接確認できる。

| パイプライン | 役割 | 出力 | LLM呼び出し回数 |

|---|---|---|---|

ag-refresh(フル) |

全モジュールをゼロから学習 | .antigravity/module_registry.md + モジュール別ナレッジ |

モジュール数+α |

ag-refresh --quick |

前回以降の差分のみ更新 | 変更モジュールのナレッジ再生成 | 変更モジュール分のみ |

ag-ask |

Router→ModuleAgent経路でQ&A | ファイルパス+行番号付き回答 | 2〜3回 |

ag-mcp |

MCPサーバーとして常駐 | IDEからask_project/refresh_project呼び出し |

質問ごと |

Claude Codeの全機能解説でも触れているように、CLAUDE.mdの肥大化はAI IDEの共通課題だ。Antigravityはこの問題を「ファイルベースの分散知識管理」で構造的に解決している。CLAUDE.mdは薄く保ち、実態は.antigravity/配下の構造化ナレッジに置く、という発想の転換が効いている。

ag-refresh(構築)とag-ask(応答)の2パイプラインが中核各エージェントはエビデンススパン付きの構造化クレームを出力する

CLAUDE.mdを薄く保ち、構造化ナレッジに実態を置くのがAntigravity流

MCP連携でClaude Codeから直接質問する

AntigravityはMCPサーバーとしても動作する。Claude Codeに登録すれば、ask_projectツールでコードベースへの質問をIDE内から直接実行できる。手でターミナルに戻ってag-askを叩く必要がない。

# MCPサーバーとして登録

claude mcp add antigravity ag-mcp -- --workspace $(pwd)

登録後、Claude Codeは以下のツールを使える。

| MCPツール | 機能 |

|---|---|

ask_project(question) |

Router経由でModuleAgent/GitAgentに質問。ファイルパス+行番号付きで回答 |

refresh_project(quick?) |

コード変更後にナレッジベースを再構築。quick=trueで差分のみ更新 |

MCPサーバーの仕組みそのものについて詳しくはMCPサーバー構築ガイドを参照してほしい。Antigravityは、MCPを「外部データ接続口」として使う典型例だ。

Claude Codeからask_projectを呼ぶと、RouterとModuleAgentがバックグラウンドで動き、IDEにはエビデンス付きの回答だけが返る。ユーザー体験としては「Claudeがプロジェクトを本当に理解している」ように感じられる。

さらに、外部MCPサーバー(GitHub、データベース等)への接続もサポートしている。mcp_servers.jsonで設定すれば、エージェントが外部ツールを自動検出・利用できる。

{

"servers": [

{

"name": "github",

"transport": "stdio",

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-github"],

"enabled": true

}

]

}

この設定を読み込ませると、ModuleAgentが回答を組み立てる際にGitHub Issue/PR情報も参照できるようになる。コードベース内の知識と外部世界の知識をシームレスに統合する構造だ。

CLIからの

ag-askに比べて、IDEコンテキストを保ったまま質問→コード編集のサイクルを高速に回せる。Claude Codeの会話ログに

ask_projectの結果が残るため、後から「なぜこの実装にしたか」を追跡しやすい。

AntigravityはMCPサーバーとして動作し、Claude CodeからIDE内で質問可能

ask_project/refresh_projectの2ツールで質問と再学習を完結外部MCPサーバー(GitHub等)との連携で知識を統合できる

8種のAI IDE対応とCLIコマンド一覧

Antigravityのアーキテクチャは「ファイルベース」であり、プラグインではない。そのため、プロジェクトファイルを読める任意のAI IDEで動作する。IDE側の更新を待つ必要がなく、新しいAI IDEが登場しても対応が容易だ。

| IDE | 設定ファイル |

|---|---|

| Cursor | .cursorrules |

| Claude Code | CLAUDE.md |

| Windsurf | .windsurfrules |

| VS Code + Copilot | .github/copilot-instructions.md |

| Gemini CLI / Codex | AGENTS.md |

| Cline | .clinerules |

| Aider | AGENTS.md |

AGENTS.mdを共通ルールブックとし、各IDEのブートストラップファイルから参照する構造が美しい。IDEを切り替えてもプロジェクト規約は変わらない。チームメンバーが別々のIDEを使っていても、全員が同じコンテキストにアクセスできる。

ForgeCodeのようなAIコード生成ツールと組み合わせる場合も、.antigravity/フォルダを共有するだけでコンテキストが統一される。Antigravityは「IDEの上位レイヤー」として機能するため、どのコード生成ツールとも相性が良い。

CLIコマンドの全体像は以下の通り。

| コマンド | 機能 | LLM必要? |

|---|---|---|

ag init <dir> |

テンプレート注入 | 不要 |

ag init <dir> --force |

既存ファイルを上書き再注入 | 不要 |

ag-refresh --workspace <dir> |

マルチエージェント自律学習 | 必要 |

ag-refresh --quick |

前回以降の変更ファイルのみ更新 | 必要 |

ag-ask "質問" |

Router経由のQ&A | 必要 |

ag-mcp --workspace <dir> |

MCPサーバー起動 | 必要 |

ag report "メッセージ" |

発見事項をメモリに記録 | 不要 |

ag log-decision "何を" "なぜ" |

アーキテクチャ判断を記録 | 不要 |

特に注目すべきはag reportとag log-decisionだ。これらはLLMを呼ばず、ユーザー(またはClaude)が発見した知見・アーキテクチャ決定を.antigravity/配下に追記する。蓄積されたメモリは次回のag-refreshで構造化ナレッジに統合され、プロジェクトの「継続学習」ループが成立する。

# アーキテクチャ判断を記録

ag log-decision "DBをPostgreSQLに移行" "読み取り負荷に対応するためレプリカ構成が必要になった"

# 発見事項をメモに残す

ag report "認証ミドルウェアの例外処理がケースCで漏れている可能性。要調査。"

ファイルベース設計により8種のAI IDEで同じルールを共有できる

AGENTS.mdを共通ルールブックとし、IDE個別ファイルから参照する構造ag report/ag log-decisionで継続学習ループを回せる

大規模プロジェクトでの実証結果

公式READMEでは、12,000ファイル・348Kスターの大規模OSSプロジェクト(TypeScript + Swift + Kotlin)でのベンチマークが公開されている。小規模プロジェクトとの比較は以下の通り。

| 指標 | 小規模(374ファイル) | 大規模(12Kファイル) |

|---|---|---|

| リフレッシュ時間 | 約10分 | 43分 |

| モジュール数 | 9 | 111 |

| ナレッジベースサイズ | 540KB | 1.5MB |

| モジュールQ&A品質 | 7/10 | 10/10 |

大規模プロジェクトでモジュールQ&Aが10/10を記録している点は特筆に値する。一般的なAI IDEでは「プロジェクトが大きいほど精度が落ちる」のが常識だが、Antigravityではむしろ大規模でスコアが上がった。モジュール分割が効いているほど、Routerの判断精度と各ModuleAgentの専門性が高まるためだ。

大きなディレクトリ(262グループのextensions/、363グループのsrc/)がauto-splitで自動分割され、8並列で処理されることで、以前は5時間以上かかっていた処理が43分で完了するようになった。

モジュール単位の質問(「Telegram連携はどう動く?」「Discord音声チャンネルの実装は?」)ではアーキテクチャ図・コードサンプル・設計パターンまで含む回答が得られる一方、クロスモジュールの質問(「テスト全体の構成は?」)ではタイムアウトが発生するケースもある。公式の推奨設定ではAG_ASK_TIMEOUT_SECONDS=120(デフォルト45秒から引き上げ)が最も効果的なチューニングとされている。

「スケールするほどモジュール分割の効果が増す。これは従来のモノリシックなコンテキスト投入とは正反対の特性だ」

374ファイル"] --> B["9モジュール

Q&A: 7/10"] C["大規模プロジェクト

12Kファイル"] --> D["111モジュール

Q&A: 10/10"] B --> E["Routerは単純

分割効果は限定的"] D --> F["Routerが効率的に絞り込み

ModuleAgentが専門化"]

| 質問タイプ | スコア | コメント |

|---|---|---|

| モジュール単位の質問 | 10/10 | Routerが責任モジュールを特定しやすい |

| 設計パターン・規約確認 | 9/10 | .antigravity/conventions.mdで一貫した回答 |

| クロスモジュール質問 | 6-7/10 | タイムアウトが発生する場合あり、タイムアウト延長で改善 |

| 変更履歴・Git質問 | 8/10 | GitAgentが担当、commit単位での説明が得意 |

12Kファイル規模でもモジュールQ&A 10/10を記録、スケールするほど効果増

auto-splitで大ディレクトリを8並列処理、43分で全モジュール学習完了

クロスモジュール質問は

AG_ASK_TIMEOUT_SECONDS=120で安定化

運用パターンと継続学習ループ

Antigravityの真価は「一度入れて終わり」ではなく、日々のコード変更と学習をループさせる点にある。公式が推奨する運用パターンを整理する。

パターン1:日次リフレッシュ+都度質問

# 毎朝プロジェクトに入ったら差分だけ更新

ag-refresh --quick --workspace .

# 実装前に関連モジュールの理解を深める

ag-ask "支払い処理フローを実装する前に、既存のPaymentServiceの責務を説明して"

差分更新なら数分で完了するため、日次ルーチンに組み込める。朝イチで--quickを叩いておけば、1日の質問がすべて最新ナレッジに基づく。

パターン2:アーキテクチャ決定の記録

# 大きな設計判断があったら即座に記録

ag log-decision "GraphQL→tRPCへ移行" "Next.js統合とエンドツーエンド型安全性を優先"

# 要調査事項はreportで残す

ag report "Redisのキー衝突問題: user:*とsession:*が同一DBで競合する可能性"

記録された判断と発見は次回のag-refreshでナレッジベースに統合される。「なぜこの設計にしたか」がコードベースに紐付いた形で蓄積されるため、新メンバーのオンボーディングコストが劇的に下がる。

パターン3:CIパイプラインへの組み込み

# .github/workflows/antigravity.yml

name: Antigravity Knowledge Refresh

on:

push:

branches: [main]

jobs:

refresh:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v4

- name: Install Antigravity

run: |

pip install "git+https://github.com/study8677/antigravity-workspace-template.git#subdirectory=cli"

pip install "git+https://github.com/study8677/antigravity-workspace-template.git#subdirectory=engine"

- name: Refresh knowledge base

env:

OPENAI_API_KEY: $

OPENAI_BASE_URL: $

run: ag-refresh --quick --workspace .

- name: Commit updated knowledge

run: |

git config user.name "antigravity-bot"

git add .antigravity/

git diff --quiet --cached || git commit -m "chore: refresh antigravity knowledge"

git push

mainブランチへのpushをトリガーに、.antigravity/配下のナレッジを自動更新する。チームメンバーは最新のナレッジをcloneするだけで手に入るため、個別にag-refreshを叩く必要がない。

.antigravity/配下をGitに含めるとレビュー対象が増える一方、チーム全員が同じ知識を共有できる。含めない場合は各開発者が

ag-refreshを叩く必要があり、LLMコストが分散する。CI自動更新+Git管理の組み合わせがバランスが良い。

日次

--quickリフレッシュ+都度ag-askで継続学習ループを回すag log-decisionでアーキテクチャ判断をコードと紐付けて蓄積CI自動更新+Git管理でチーム全員が同じナレッジを共有できる

まとめ:「構造化された知識」がAI IDEの次の武器になる

Antigravity Workspace Templateは、AI IDEの回答精度を「ドキュメントの量」ではなく「知識の構造」で改善するアプローチを提案している。LLM非依存のファイルベース設計により、IDE間のルール統一とエージェントの専門化を同時に実現する。

ポイントを整理すると:

- 構造: モジュール単位のModuleAgent+Router構成で質問を適切にルーティング

- ファイルベース: 8種のAI IDE横断で

.antigravity/配下を共有 - エビデンス: ファイルパス+行番号付きの構造化クレームでハルシネーション抑制

- MCP連携: Claude Code等のIDEから

ask_project/refresh_projectで直接呼び出せる - スケール: 12Kファイル規模でもモジュールQ&A 10/10、

--quickで日次運用可能 - 継続学習:

ag log-decision/ag reportでプロジェクト知識を蓄積

「エージェントに全部読ませる」から「エージェントに専門家集団を作らせる」——Antigravityはこの発想の転換を体現したOSSだ。

導入はpip installとag initだけで始められる。まずは小さなプロジェクトでag-refresh → ag-askのサイクルを試し、エージェントの回答精度がどう変わるかを体感してみてほしい。その後、CI組み込みとMCP登録を進めれば、チーム全体でAI IDEの生産性が底上げされる。

📌 まとめ

- Antigravity Workspace TemplateはAI IDEの認知層として機能するマルチエージェントエンジン

- モジュール単位のModuleAgent+Routerで質問を適切にルーティングし、ファイルパス付きで回答

- 8種のAI IDE(Cursor/Claude Code/Windsurf/Gemini CLI/VS Code/Codex/Cline/Aider)横断で動作

- 12Kファイル・348Kスターの大規模プロジェクトでモジュールQ&A 10/10を記録

- MCPサーバーとしてClaude Codeから直接呼び出し可能、外部MCPサーバー連携もサポート

ag log-decision/ag reportによるプロジェクト知識の継続学習ループが組める