この記事ではDevOps・自動化に特化して解説します。AI自動化・DevOps全般は AI自動化ツール完全ガイド2026|ノーコードからコードまで徹底比較 をご覧ください。

概要

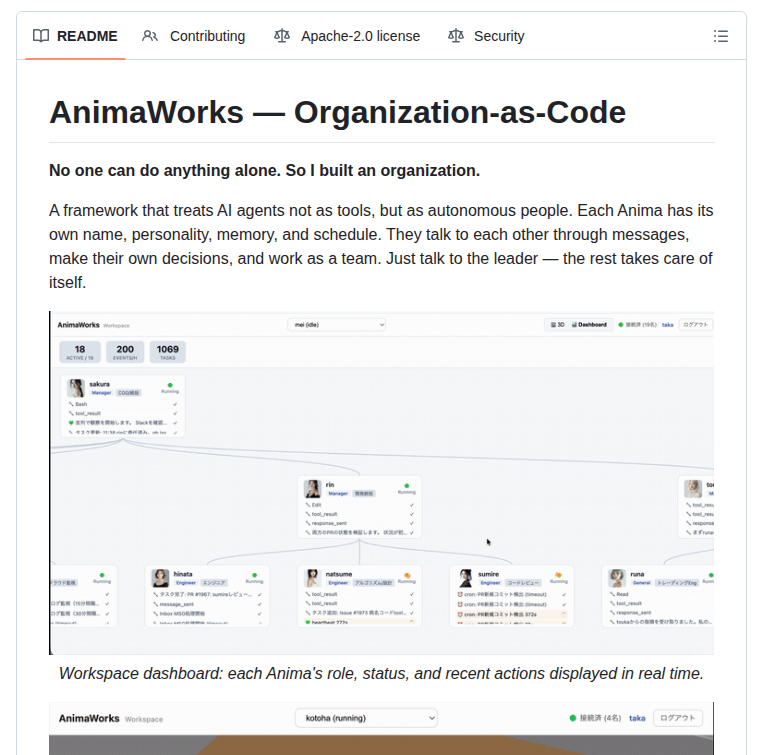

AnimaWorksは、自律型AIエージェントを組織として管理・運用するためのプラットフォームです。単なるAPIラッパーではなく、脳の神経生物学にインスパイアされた「記憶システム」を備えており、エージェントが学習、統合、忘却といった人間的なプロセスを経験できる設計になっています。AIエージェントフレームワークの比較としてDify 使い方:ノーコードでAIワークフローを構築する完全ガイドやLangChain 日本語解説:エージェント構築から本番運用までも参考になります。

複数のAIモデルを使い分ける場合、あるモデルで得た知見が別のモデルに引き継がれないという問題がありました。AnimaWorksはエージェント間で記憶を共有することで、単なるマルチモデル統合ではなく「学習する組織」の実現を目指しています。

主な機能

- マルチモデル統合管理:Claude、Codex、Gemini、Cursor、Ollamaなど異なるAIモデルを統一インターフェースで操作し、タスクに応じた最適なモデル選択を自動化

- 脳インスパイアメモリシステム:エージェントが経験したタスク結果を記憶し、時系列での統合・圧縮、優先度ベースの忘却メカニズムで効率的な学習を実現

- Organization-as-Code:YAML/JSON形式でAIエージェント組織全体の構成、ロール、ワークフローをコード化し、バージョン管理とCI/CDパイプラインに統合

- 自律型タスク分配:複数エージェント間でタスクを自動分配し、相互参照や並列実行、失敗時の自動フェイルオーバーをサポート

- メモリ統合と忘却スケジューリング:重要な経験は長期記憶へ、細部は忘却するなど、人間の脳の記憶メカニズムをシミュレート

- 監査ログと説明可能性:すべてのエージェント判断を記録し、なぜそのモデルを選んだのか、どの過去経験から判断したのかを追跡可能

- ローカル実行オプション:Ollamaサポートにより、機密データはオンプレミスで処理しながらクラウドモデルとのハイブリッド運用も可能

技術スタック

- 言語:Python 3.10+、TypeScript(オプション)

- AIモデルAPI:Anthropic Claude API、OpenAI Codex/GPT API、Google Gemini API、Ollama(ローカル)

- オーケストレーション:LangChain、LlamaIndex(検索拡張生成用)

- メモリ管理:PostgreSQL/SQLite、Vector DB(Weaviate、Pinecone)

- 設定管理:Pydantic、YAML パーサー

- 監査・ログ:Python logging、OpenTelemetry

- 依存ツール:Docker、Git(Organization-as-Code向け)

導入方法

インストール

pip install animaworks

初期設定

- 設定ファイル作成(

organization.yaml):

agents:

- name: code_generator

model: claude-3-opus

role: "コード生成専門"

memory_type: "persistent"

- name: tester

model: gpt-4

role: "テスト作成専門"

workflows:

- name: "feature_dev"

steps:

- agent: code_generator

prompt: "新機能のコードを生成"

- agent: tester

prompt: "テストコードを生成"

- API キー設定:

export ANTHROPIC_API_KEY="your-key"

export OPENAI_API_KEY="your-key"

- エージェント組織を起動:

anima init my_org

cd my_org

anima run workflow feature_dev --persistent

競合比較

| 項目 | AnimaWorks | LangChain | AutoGPT | CrewAI |

|---|---|---|---|---|

| マルチモデル対応 | ✓(統合記憶共有) | ✓(統合記憶なし) | ○(限定的) | ✓(統合記憶なし) |

| 脳インスパイア記憶 | ✓(成長・統合・忘却) | ✗ | ✗ | ✗ |

| Organization-as-Code | ✓(完全対応) | ✓(部分的) | ✗ | ○(限定的) |

| ローカル実行(Ollama) | ✓ | ✓ | ○ | ○ |

| 監査ログ・説明可能性 | ✓(詳細) | ○(基本的) | ○ | ○ |

差別化ポイント:AnimaWorksの最大の特徴は、「エージェントが学習する」という概念です。LangChainやCrewAIはタスク実行のフローを管理しますが、前回のタスク結果から何を学んだかは記録されません。複数エージェントの協調についてはOpenHands AI:オープンソースAIエージェントでコード自動生成を実現でも詳しく解説しています。AnimaWorksは神経生物学の記憶メカニズムを導入し、エージェント間で知見を共有し、時系列での学習曲線を実現します。これにより、同じ問題に対する解答品質が日々向上していくため、長期的な運用でのROIが大幅に改善されます。

こんな人におすすめ

-

複数のAIモデルを組み合わせて運用している企業のエンジニア:Claude、GPT、Geminiなど複数モデルを使い分けている場合、メモリ共有とモデル選択の最適化が自動化され、オーケストレーションの複雑さが大幅に軽減されます。

-

反復的・継続的なAI業務を自動化したい人:毎日・毎週繰り返されるレポート生成、データ分析、コード生成などの業務では、エージェントの学習による品質向上が月を重ねるごとに複利効果で積み上がります。

-

AIエージェントの決定理由を監査・追跡したい組織:金融や医療などのコンプライアンス要求が高い業界では、「なぜそのAIがそう判断したのか」を説明可能性により実現でき、規制対応が容易になります。

-

オンプレミス・プライベートLLMの運用を検討している企業:OllamaサポートでローカルLLMとクラウドモデルのハイブリッド運用が可能なため、機密データ保護と高性能モデルの利用を両立できます。

-

AIエージェントの組織構造をコード化・バージョン管理したい開発チーム:Organization-as-Code により、エージェント設定をGitで管理でき、CI/CDパイプラインへの統合やロールバックが容易になるため、運用品質が飛躍的に向上します。

関連記事: AI自動化ツール完全ガイド2026|ノーコードからコードまで徹底比較