この記事ではDevOps・自動化に特化して解説します。AI自動化・DevOps全般は AI自動化ツール完全ガイド2026|ノーコードからコードまで徹底比較 をご覧ください。

概要

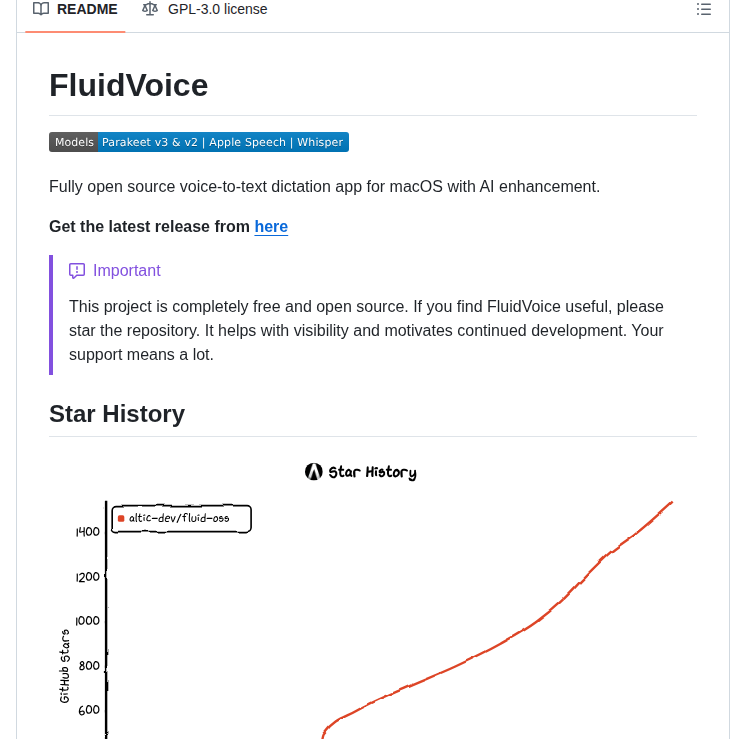

FluidVoiceは、Altic Devが開発するリアルタイム音声合成・認識を統合したAIツールです。自然な日本語音声生成と高精度な音声認識を同一プラットフォーム上で実現し、音声インターフェースが必要なアプリケーション開発を加速します。2024年以降、音声AIの需要拡大に応じて開発が進められており、ローカル実行とクラウド連携の両立が特徴となっています。

LangChainなどのLLMフレームワーク(LangChain 日本語入門:LLMエージェント開発を簡単にするPythonフレームワーク)と組み合わせることで、音声対話型AIエージェントを短時間で構築できます。

主な機能

- リアルタイム音声合成:テキストを低遅延で自然な音声に変換し、ストリーミング出力対応で即座に再生可能です。

- 高精度音声認識:日本語・英語を含む複数言語の音声をリアルタイムで文字起こしし、背景ノイズ環境でも精度を維持します。

- マルチモーダル統合:音声合成・認識・テキスト処理を統合したパイプラインにより、音声アシスタント開発が単純化されます。

- ローカル・クラウド柔軟運用:オンプレミス環境での推論実行とクラウドAPI呼び出しの両方に対応し、インフラに応じた選択が可能です。

- カスタムボイス対応:話者の個性を保持した音声生成が可能で、ブランド音声やパーソナライズされたアシスタント実装に対応します。

- 低レイテンシーストリーミング:バッファリングを最小化した設計で、対話型アプリケーションでの実用的な応答速度を実現します。

- API標準化:REST・WebSocket・gRPCなど複数プロトコルをサポートし、既存システムへの組み込みが容易です。

技術スタック

- 実装言語:Python、C++(推論エンジン)、JavaScript/TypeScript(フロントエンド)

- 音声モデル基盤:Transformer ベースのエンコーダ・デコーダ、HiFi-GAN ボコーダ

- フレームワーク:PyTorch、ONNX Runtime(推論最適化)

- 音声処理:librosa、PyAudio、WebRTC

- サーバー実装:FastAPI、Flask、Node.js

- デプロイメント:Docker、Kubernetes、AWS Lambda、Google Cloud Run

- GPU最適化:CUDA、TensorRT(NVIDIA)、CoreML(Apple Silicon)

FluidVoice 音声処理パイプライン

FluidVoiceの内部アーキテクチャは、音声入力から出力までを段階的に処理します。

マイク / ファイル"] --> B["前処理

ノイズ除去 / 正規化"] B --> C["音声認識エンジン

Transformer ASR"] C --> D["テキスト処理

形態素解析 / 意図抽出"] D --> E["LLM連携

応答生成"] E --> F["音声合成エンジン

TTS + HiFi-GAN"] F --> G["後処理

韻律制御 / ストリーミング"] G --> H["音声出力

スピーカー / WebSocket"] style A fill:#e8f4fd,stroke:#2196F3 style H fill:#e8f5e9,stroke:#4CAF50 style C fill:#fff3e0,stroke:#FF9800 style F fill:#fff3e0,stroke:#FF9800

入力段階でWebRTCベースのノイズ除去を行い、ASRエンジンが音声をテキストに変換します。テキスト処理層でLLMと連携した意図解釈が行われ、TTSエンジンとHiFi-GANボコーダが自然な音声を合成してストリーミング出力します。

導入方法

GitHubからのインストール:

git clone https://github.com/altic-dev/FluidVoice.git

cd FluidVoice

pip install -e .

PyPI経由(リリース版がある場合):

pip install fluidvoice

基本的な使用例:

from fluidvoice import SpeechSynthesizer, SpeechRecognizer

# 音声合成

synthesizer = SpeechSynthesizer(model="default-jp")

audio = synthesizer.synthesize("こんにちは、世界")

audio.save("output.wav")

# 音声認識

recognizer = SpeechRecognizer(language="ja")

text = recognizer.recognize_from_file("input.wav")

print(text)

Dockerでのコンテナ運用:

docker build -t fluidvoice .

docker run -p 8000:8000 fluidvoice

競合比較

| 項目 | FluidVoice | Google Cloud Speech-to-Text | Azure Speech Services |

|---|---|---|---|

| 音声合成品質 | 自然な日本語、カスタムボイス対応 | 高精度だが合成品質は限定的 | 企業向け多言語対応 |

| 認識精度 | 日本語特化、ローカル推論対応 | クラウドのみ、高精度 | クラウドのみ、業界別モデル |

| ローカル実行 | 完全対応、オンプレミス可 | 不可(クラウド必須) | 不可(クラウド必須) |

| レイテンシー | 低遅延ストリーミング | 数秒単位 | 数秒単位 |

| 価格モデル | オープンソース、セルフホスト | 従量課金(クラウド) | 従量課金(クラウド) |

| カスタマイズ性 | モデル再学習・ファインチューニング可能 | 限定的 | 限定的 |

FluidVoiceの最大の差別化点はローカル実行とカスタマイズ性です。Google・Azureはクラウド型で高精度ですが、データプライバシーやコスト削減を重視する環境ではFluidVoiceが優位性を持ちます。特に日本語対応の自然性と、話者カスタマイズ機能は競合にない強みであり、音声AIの主権性を確保したい企業向けの選択肢として機能します。

LLMパイプラインとの統合

FluidVoiceは単体の音声ツールにとどまらず、LLMベースのエージェントパイプラインの音声入出力レイヤーとして機能します。RAGFlowのような検索拡張生成(RAG)システムと組み合わせれば、音声で質問を受け付けて社内ドキュメントから回答を返す音声QAシステムを構築できます。

また、Semantic Kernel入門:Microsoft製AIエージェントフレームワークのようなエージェントフレームワークと統合することで、複数のAIサービスを音声インターフェース経由でオーケストレーションする高度な音声アシスタントの実装も視野に入ります。

- 日本語モデルの選択:

model="default-jp"で日本語特化モデルを明示的に指定する。汎用モデルより自然な発音・アクセントが得られます。 - ストリーミング出力の活用:長文の読み上げは

stream=Trueオプションで逐次出力に切り替えると、ユーザーが最初の音声を聞くまでの待ち時間(TTFB)を大幅に短縮できます。 - WebSocket連携:リアルタイム音声対話アプリでは REST より WebSocket エンドポイントを使うことで往復レイテンシーを削減できます。マイク入力の継続的なストリーミングに向いています。

- カスタムボイスの学習データ:話者適応には最低でも数十秒〜数分の高品質な音声サンプルが必要です。録音環境(静音室・24bit/48kHz以上)が品質を左右します。

- プライバシー設計:医療・金融・行政向けアプリでは音声データをクラウド送信しないオンプレミス構成が重要です。FluidVoiceのローカル推論モードを活用し、通信経路に機密音声が乗らない設計にします。

こんな人におすすめ

- プライバシーを重視する開発チーム:音声データをオンプレミスで処理できるため、クラウド送信に制約がある企業・自治体での導入に適しています。

- 日本語音声アプリケーション開発者:日本語特化の合成・認識モデルにより、多言語汎用ツールより精度と自然性が優れた実装が実現できます。

- 音声AIコスト削減を目指す組織:セルフホストにより、スケール後のクラウドAPI費用を大幅削減でき、長期的な経営効率化が可能です。

- 音声ブランディング・カスタムボイス実装者:音声生成モデルの再学習機能により、企業やサービス固有の音声アイデンティティを構築できます。

- AIスタートアップ・研究機関:オープンソース形式でモデルアーキテクチャへのアクセスが保証され、研究目的での検証・拡張が容易です。

関連記事: AI自動化ツール完全ガイド2026|ノーコードからコードまで徹底比較