この記事ではRAGに特化して解説します。RAG全般は RAGとは?仕組み・構築・ベクトルDB選定まで【2026年完全ガイド】 をご覧ください。

DeepWiki-Openとは — リポジトリからAIドキュメントを自動生成するOSS

DeepWiki-Openは、GitHub・GitLab・BitbucketのリポジトリをAIで解析し、構造化されたWikiドキュメントを自動生成するオープンソースツールだ。2026年4月時点でGitHub Star数は15,500を超え、MITライセンスで公開されている。

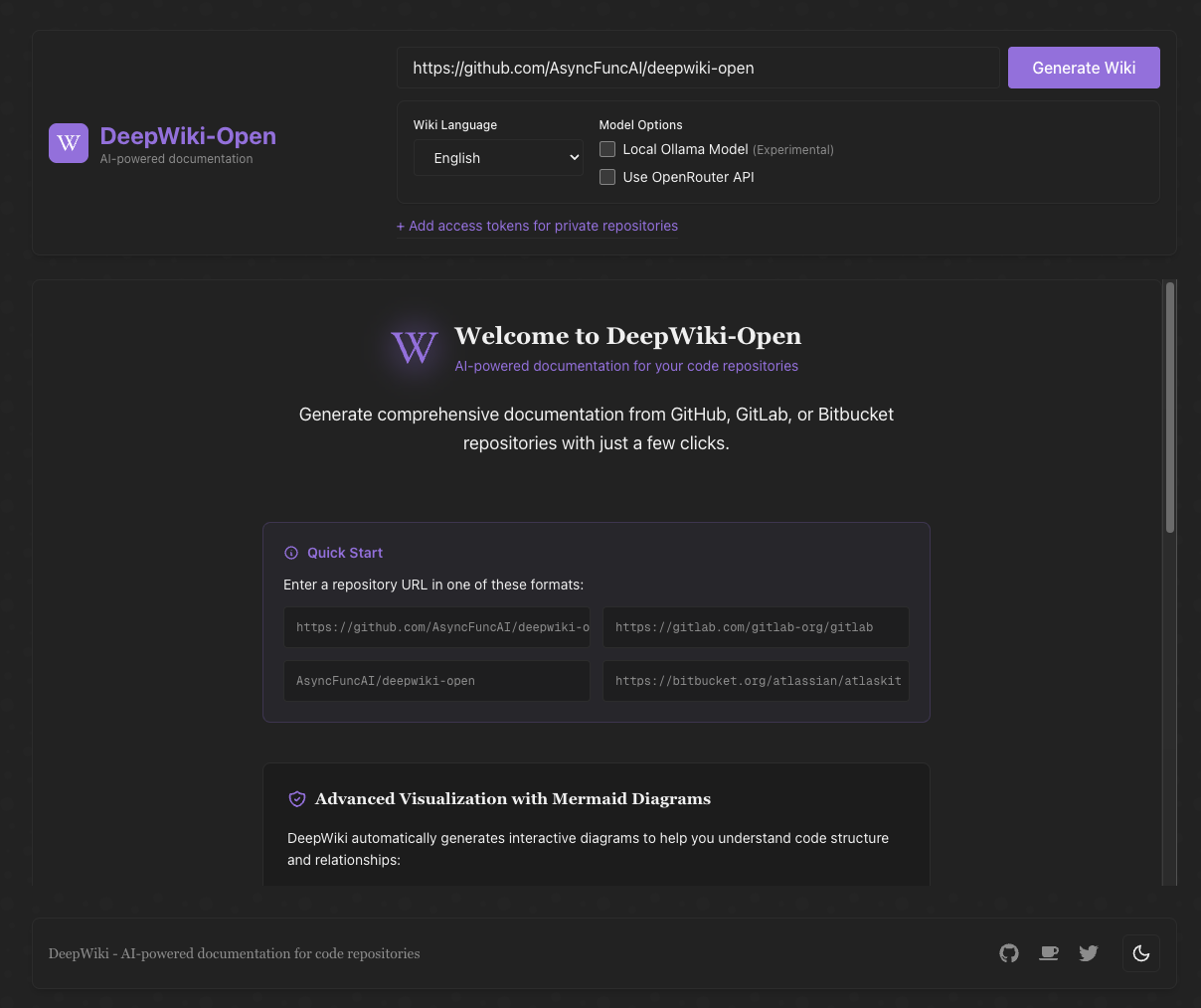

READMEすら読まずにコードの全体像を把握したい、新しいOSSの仕組みを素早く理解したい — そんな場面で威力を発揮する。リポジトリURLを入力するだけで、以下の成果物が自動生成される。

- 構造化されたWikiページ — コードベースの機能・設計・モジュール構成を整理したドキュメント

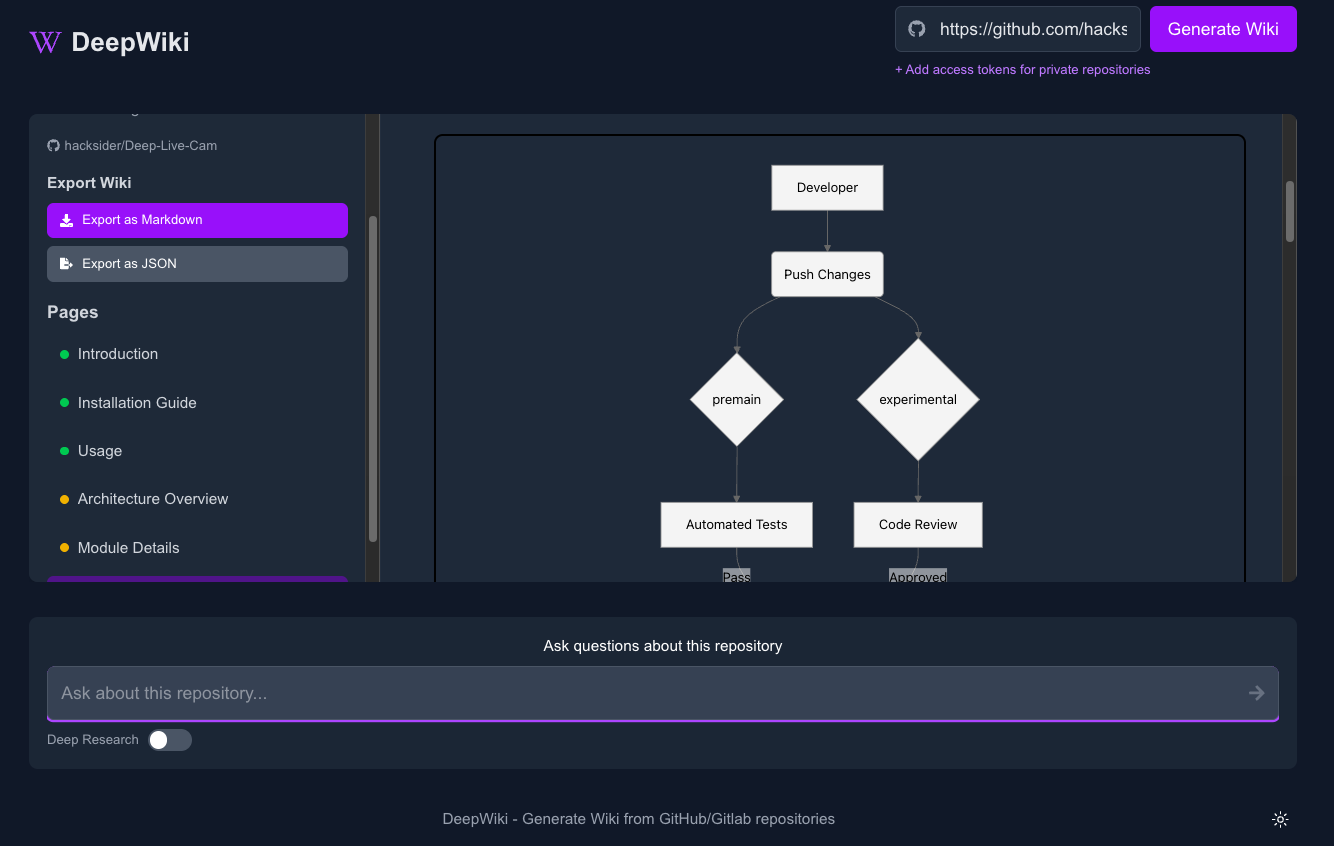

- Mermaid図 — アーキテクチャ図、データフロー図、シーケンス図を自動描画

- RAGベースQ&A — コードに対して自然言語で質問し、関連コードを根拠にした回答を取得

- DeepResearch — 複雑なテーマについて最大5回の反復調査を実行する深掘り機能

技術スタックはフロントエンドがNext.js 15 + React 19、バックエンドがFastAPI(Python)。ベクトル検索にFAISS、LLMフレームワークにAdalFlowを採用している。

なお、同名の「DeepWiki」(Cognition AI / Devin提供のホスティング版)とは別プロジェクトだ。本記事はセルフホスト可能なOSS版「DeepWiki-Open」を解説する。

仕組みと主要機能 — RAG・ベクトル検索・DeepResearch

DeepWiki-Openの処理パイプラインは5ステップで構成される。

GitHub / GitLab / Bitbucket"] --> B["リポジトリのクローン

プライベートリポも対応"] B --> C["コード解析・チャンク分割

AdalFlow + テキストスプリッター"] C --> D["ベクトル埋め込み生成

FAISS インデックス構築"] D --> E["LLMによるWiki生成

7プロバイダーから選択"] E --> F["Wiki・Mermaid図・Q&A

ブラウザで閲覧"]

ベクトル埋め込みとRAG — コードをチャンクに分割し、FAISS(Facebook AI Similarity Search)でベクトルインデックスを構築する。Q&A機能では質問に関連するコード断片をベクトル検索で取得し、LLMに渡して根拠に基づいた回答を生成する。RAGFlowのようなエンタープライズRAGとは異なり、コードリポジトリ特化の軽量実装だ。

DeepResearch — 単純なQ&Aでは足りない複雑なテーマに対応する機能。「リサーチ計画→調査→中間報告→追加調査→最終結論」のサイクルを最大5回反復する。大規模リポジトリのアーキテクチャ分析や、モジュール間の依存関係の調査に有効。

プライベートリポジトリ対応 — GitHub・GitLabのPersonal Access Tokenを入力することで、プライベートリポジトリも解析できる。

データ保存先 — すべてのデータは ~/.adalflow/ 配下に保存される。

| ディレクトリ | 内容 |

|---|---|

~/.adalflow/repos/ |

クローンしたリポジトリ |

~/.adalflow/databases/ |

ベクトル埋め込み・インデックス |

~/.adalflow/wikicache/ |

生成済みWikiのキャッシュ |

インストールとLLMプロバイダー設定

Dockerで起動(推奨)

最も手軽なのはDocker Composeでの起動だ。

# リポジトリをクローン

git clone https://github.com/AsyncFuncAI/deepwiki-open.git

cd deepwiki-open

# APIキーを設定(少なくとも1つ必要)

cat > .env << 'EOF'

OPENAI_API_KEY=sk-your-openai-key

GOOGLE_API_KEY=your-google-api-key

EOF

# Docker Composeで起動

docker-compose up

起動後、http://localhost:3000 にアクセスすればWiki生成画面が表示される。

Docker Hubからイメージを直接pullして実行することもできる。

docker pull ghcr.io/asyncfuncai/deepwiki-open:latest

docker run -p 8001:8001 -p 3000:3000 \

-e OPENAI_API_KEY=sk-your-key \

-e GOOGLE_API_KEY=your-google-key \

-v ~/.adalflow:/root/.adalflow \

ghcr.io/asyncfuncai/deepwiki-open:latest

手動セットアップ

Docker以外で動かす場合は、バックエンドとフロントエンドを個別に起動する。

# バックエンド(FastAPI / ポート8001)

python3 -m pip install poetry==2.0.1

poetry install -C api

python3 -m api.main

# フロントエンド(Next.js / ポート3000)— 別ターミナルで

npm install

npm run dev

7つのLLMプロバイダー

DeepWiki-Openは7つのLLMプロバイダーをサポートする。UIから切り替え可能で、用途やコストに応じて選択できる。

| プロバイダー | デフォルトモデル | 必要な環境変数 | 特徴 |

|---|---|---|---|

| Google Gemini | gemini-2.5-flash | GOOGLE_API_KEY |

高速・低コスト |

| OpenAI | gpt-5-nano | OPENAI_API_KEY |

高品質・汎用 |

| OpenRouter | 各種 | OPENROUTER_API_KEY |

Claude・Llama等を統一APIで利用 |

| Azure OpenAI | gpt-4o | AZURE_OPENAI_* |

エンタープライズ向け |

| Ollama | llama3 | なし(ローカル) | 完全ローカル・無料 |

| AWS Bedrock | 各種 | AWS認証情報 | AWSインフラ統合 |

| Alibaba Dashscope | Qwen系 | DASHSCOPE_API_KEY |

OpenAI互換エンドポイント |

埋め込みモデルも切替可能で、OpenAI(text-embedding-3-small)、Google(text-embedding-004)、Ollama(ローカル)、AWS Bedrockから選べる。ただし埋め込みプロバイダーを変更すると、既存のベクトルインデックスを再生成する必要がある点に注意。

Ollamaでの完全ローカル実行

外部APIキーなしで動かしたい場合はOllamaを使う。

# Ollamaのインストールとモデル取得

curl -fsSL https://ollama.ai/install.sh | sh

ollama pull llama3

ollama pull nomic-embed-text

# .envにOllamaのエンドポイントを設定

echo "OLLAMA_HOST=http://localhost:11434" > .env

# Docker Composeで起動

docker-compose up

UIのプロバイダー選択で「Ollama」を選べば、すべての処理がローカルで完結する。

MCP連携とアクセス制御

DeepWiki MCPサーバー

Cognition AIが提供するDeepWiki MCPサーバーを使えば、AIコーディングツールからリポジトリのドキュメントに直接アクセスできる。公開リポジトリが対象で、50,000以上のリポジトリがインデックス済み。

Claude Codeでの設定は1コマンドで完了する。

# Claude CodeにDeepWiki MCPサーバーを追加

claude mcp add -s user -t http deepwiki https://mcp.deepwiki.com/mcp

CursorやWindsurfでは mcp.json に以下を追加する。

{

"mcpServers": {

"deepwiki": {

"serverUrl": "https://mcp.deepwiki.com/mcp"

}

}

}

MCPサーバーは3つのツールを提供する。

| ツール | 用途 |

|---|---|

read_wiki_structure |

リポジトリのドキュメント構造(目次)を取得 |

read_wiki_contents |

ドキュメントの内容を読み取り |

ask_question |

リポジトリについてAIに質問 |

セルフホスト版のアクセス制御

DeepWiki-Openをチーム内で公開する場合、認証モードで保護できる。

# .envに追加

DEEPWIKI_AUTH_MODE=true

DEEPWIKI_AUTH_CODE=your-secret-code

類似ツール比較 — OpenDeepWiki・Cognition DeepWiki

リポジトリからドキュメントを自動生成するツールの比較。

| 特性 | DeepWiki-Open | OpenDeepWiki | Cognition DeepWiki |

|---|---|---|---|

| 開発元 | AsyncFuncAI(個人) | AIDotNet | Cognition AI(Devin) |

| GitHub Star | 15,500+ | 3,000+ | — (プロプライエタリ) |

| セルフホスト | 対応 | 対応 | 不可 |

| LLMプロバイダー | 7種(Gemini, OpenAI, Ollama等) | OpenAI中心 | 非公開 |

| ローカルLLM | Ollama対応 | 限定的 | 不可 |

| プライベートリポ | トークン入力で対応 | 対応 | Devinアカウント必要 |

| MCP連携 | なし(ホスティング版のみ) | なし | 対応 |

| DeepResearch | 対応(最大5反復) | 非対応 | Ask Devinとして提供 |

| 技術スタック | Python + Next.js | C# + TypeScript | 非公開 |

| ライセンス | MIT | MIT | プロプライエタリ |

| コスト | LLM API料金のみ | LLM API料金のみ | 公開リポは無料 |

選び方のポイント — セルフホストで自由にカスタマイズしたいならDeepWiki-Open。API不要で完全ローカル実行ならOllama連携のDeepWiki-Openが唯一の選択肢。公開リポジトリのドキュメントを手軽に参照するだけならCognition DeepWikiのホスティング版が最も簡単で、github.com を deepwiki.com に置き換えるだけで使える。

制限事項・注意点

大規模リポジトリの処理時間 — モノレポや巨大リポジトリでは解析・埋め込み生成に時間がかかる。api/config/repo.json でファイルフィルタやサイズ上限を調整できる。

埋め込みプロバイダーのロックイン — OpenAIの埋め込みで生成したインデックスをGoogleの埋め込みで検索することはできない。プロバイダーを変更する場合はインデックスの再生成が必要。

メンテナンス体制 — 開発者は新プロジェクト「AsyncReview」に開発の主軸を移しており、DeepWiki-Openはメンテナンスモードと公表されている。コミュニティの活発さ(1,700フォーク)がリスクを緩和している。

認証モードの制約 — DEEPWIKI_AUTH_MODE はフロントエンドを保護するが、バックエンドAPIへの直接アクセスは完全には防げない。公開環境ではリバースプロキシで追加保護が推奨される。

関連記事: RAGとは?仕組み・構築・ベクトルDB選定まで【2026年完全ガイド】