この記事ではAIエージェントに特化して解説します。AIエージェント全般は AIエージェントフレームワーク比較2026年版 をご覧ください。

AI Scientist v2とは — AIが仮説から論文まで自律的に研究する時代

AI Scientist v2は、日本発のAI研究企業Sakana AIが開発した自律型科学研究エージェントだ。GitHub Star数は5,500を超え、Apache 2.0ライセンスで公開されている。

科学研究の典型的なサイクルを考えてみよう。研究者はまず先行研究を読み込んで仮説を立てる。次に実験を設計し、コードを書いて実行する。結果を分析し、うまくいかなければ仮説を修正して再実験。最終的に論文としてまとめ、査読に提出する。このサイクルに数週間から数か月、場合によっては半年以上かかるのが常識だった。AI Scientist v2はこの全工程をAIが自律的に実行する。人間が指定するのは研究テーマだけだ。

このシステムが生成した論文は、ICLR 2025(International Conference on Learning Representations)のワークショップで実際に採択されている。ICLRは機械学習分野のトップカンファレンスの一つであり、AIが書いた論文がその場で認められた事例として学術界でも大きな注目を集めた。arXiv論文(2504.08066)で手法の詳細が公開されており、再現可能な形で研究成果が共有されている。

- 仮説生成 → 実験設計 → コード実装・実行 → データ分析 → 論文執筆を全自動化

- v2ではテンプレート不要の汎用設計(v1はテーマごとにテンプレートが必須だった)

- Progressive Agentic Tree Search(PATS)で研究の方向性を自動最適化

- 1実験あたり約15〜20ドル + 論文執筆約5ドルで実行可能

- OpenAI、Google Gemini、Claude(AWS Bedrock経由)の複数LLMに対応

- 並列実行(num_workers)でスループット向上

Sakana AIは東京に本社を構えるAI研究企業で、Google DeepMind出身のDavid Ha氏とLlion Jones氏(Transformerの共同発明者)が共同設立した。「進化」と「自然からのインスピレーション」をコア理念とし、従来とは異なるアプローチでAI研究を推進している。AI Scientist v2は同社の代表的な研究成果をOSSとして公開したプロジェクトであり、「AIが科学者として自律的に研究を行う」という、これまでSFの領域だった概念を実装に落とし込んでいる。

アーキテクチャ — Progressive Agentic Tree Searchの仕組み

AI Scientist v2の中核はProgressive Agentic Tree Search(PATS)と呼ばれるアルゴリズムだ。これは研究探索を木構造として表現し、best-first tree search(最良優先探索)で有望な研究方向を自動的に選択・深掘りする。

(人間が指定)"] --> B["Ideation Phase

仮説・アイデア生成"] B --> C["Experiment Manager Agent

探索戦略の決定"] C --> D{"Progressive Agentic

Tree Search"} D --> E1["ノード1: 仮説A

実験実行・評価"] D --> E2["ノード2: 仮説B

実験実行・評価"] D --> E3["ノード3: 仮説C

実験実行・評価"] E1 --> F["Best-First選択

最も有望なノードを展開"] E2 --> F E3 --> F F --> G["選択されたノードを深掘り

サブ仮説の生成・検証"] G --> H["論文執筆

LaTeX形式で自動生成"] H --> I["Semantic Scholar API

新規性チェック"]

2つの主要コンポーネント

Experiment Manager Agent — 研究探索全体を統括する司令塔エージェント。木構造のどのノード(仮説)を次に展開するかを判断し、実験の優先順位を決定する。単純にランダムに探索するのではなく、これまでの実験結果のスコアやフィードバックを踏まえて最も有望な方向にリソースを集中させる。人間の研究者が直感的に行っている「この方向は筋が良さそうだから深掘りしよう」という判断を、AIがデータに基づいて自動化していると考えればわかりやすい。

Progressive Agentic Tree Search(PATS) — 研究のアイデアを木構造のノードとして管理するアルゴリズム。各ノードは「仮説 + 実験コード + 実行結果 + 評価スコア」で構成される。best-first search(最良優先探索)により、評価の高いノードから優先的に子ノード(派生仮説)を生成・検証していく。

PATSの特徴は「progressive(段階的)」という点にある。最初から完璧な仮説を立てようとするのではなく、粗い仮説から始めて段階的に精緻化していく。各ステップで実験結果をフィードバックとして受け取り、仮説を修正・分岐させる。このアプローチにより、研究空間を体系的かつ効率的に探索できる。行き止まりの仮説に時間を浪費するリスクも、木構造の枝刈りによって自動的に低減される。

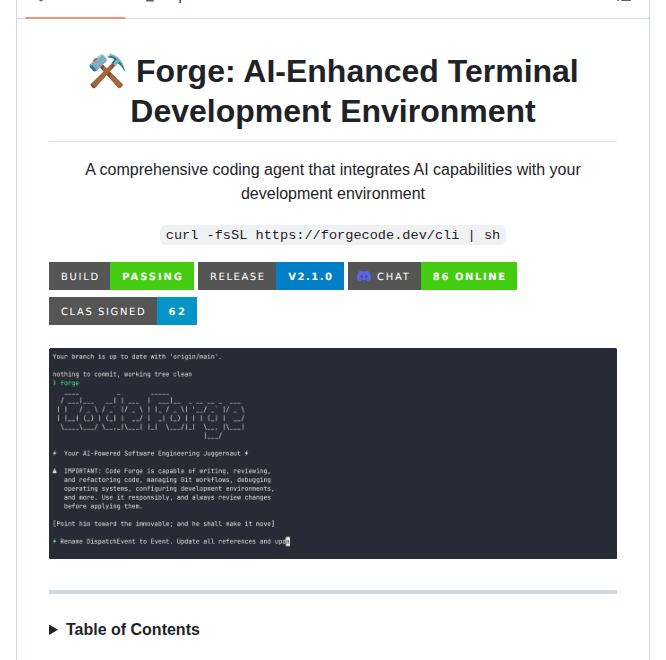

従来のAIコーディングエージェント(ForgeCodeなど)がコード生成に特化しているのに対し、AI Scientist v2は「科学的発見」のプロセス全体を自動化する点で根本的に異なる。AIエージェントフレームワークの全体像の中でも、科学研究に特化したエージェントは極めて珍しい存在だ。

研究パイプラインの詳細フロー

AI Scientist v2の研究パイプラインは、大きく4つのフェーズで構成される。

| フェーズ | 処理内容 | 担当エージェント |

|---|---|---|

| 1. Ideation(着想) | 研究テーマから複数の仮説を生成。Semantic Scholar APIで既存研究との重複をチェックし、新規性のある仮説を選定 | Ideation Agent |

| 2. Experiment(実験) | 仮説に基づいてPythonコードを自動生成・実行。実験結果のログ・データ・グラフを収集 | Experiment Manager + PATS |

| 3. Analysis(分析) | 実験データを統計的に分析。有効な結果と無効な結果を判別し、次の探索方向を決定 | Analysis Agent |

| 4. Writing(執筆) | 分析結果をもとにLaTeX形式の学術論文を自動生成。Abstract、Introduction、Method、Results、Conclusionの構成 | Writing Agent |

各フェーズは独立して動作するのではなく、前のフェーズの結果を次のフェーズが活用するパイプライン構造になっている。特にExperimentフェーズとAnalysisフェーズはPATSの探索ループ内で繰り返し実行され、実験と分析のサイクルが自動的に回る。

AI Scientist v2はSemantic Scholar APIを活用して、生成した仮説が既存の学術論文と重複していないかを自動チェックする。Semantic Scholarは2億本以上の学術論文をインデックスしており、タイトル・要旨・キーワードのセマンティック検索が可能。類似研究が見つかった場合はIdeation Agentが仮説を修正するか、差別化ポイントを明確にした新しい角度からアプローチする。これにより「既に誰かがやった研究」を無駄に繰り返すリスクを低減する。APIキーなしでも利用可能だが、キーを取得するとレートリミットが緩和される。

v1 vs v2 — テンプレート不要の汎用設計への進化

AI Scientist v2は初代AI Scientist(v1)からの大幅な進化版だ。v1からv2への変更点を理解することで、このツールの設計思想が見えてくる。

| 比較項目 | AI Scientist v1 | AI Scientist v2 |

|---|---|---|

| テンプレート | 研究テーマごとに人間がテンプレートコードを用意する必要あり | テンプレート不要。汎用的な研究テーマに対応 |

| 探索アルゴリズム | 線形的な仮説検証 | Progressive Agentic Tree Search(木構造探索) |

| 探索戦略 | 固定的 | Experiment Manager Agentが動的に最適化 |

| 対応LLM | 限定的 | OpenAI、Gemini、Claude(Bedrock)の3プロバイダー |

| 並列実行 | なし | num_workersパラメータで並列実験実行 |

| 新規性チェック | 基本的 | Semantic Scholar API統合による体系的チェック |

| 学術的実績 | — | ICLR 2025ワークショップ論文採択 |

| コスト | 不明確 | 実験約15〜20ドル + 執筆約5ドル |

v1の最大の制約は「テンプレート依存」だった。新しい研究テーマに取り組むたびに、研究者がテンプレートコードを書いてAIに渡す必要があった。これではAIの自律性が限定的で、結局は人間の準備作業が必要になる。

v2ではこの制約を撤廃し、テーマの指定だけでAIが自律的に実験環境を構築する。PATSアルゴリズムにより、探索の方向性も人間が逐一指示する必要がなくなった。この設計変更が「真の自律型科学研究エージェント」への転換点となっている。

具体的には、v1では「NanoGPTの改良」や「Diffusion Modelの最適化」といった各テーマに対して、ベースラインコード・データセット・評価スクリプトを人間が用意する必要があった。このテンプレート作成自体が数日の作業になることもあり、AI研究の自動化を謳いながら人間の準備コストが高いというジレンマがあった。

v2ではExperiment Manager Agentがテーマに応じて実験環境をゼロから構築するため、研究者は純粋に「何を調べたいか」だけを考えればよい。さらに、並列実行(num_workersパラメータ)の導入により、複数の仮説を同時に検証できるようになった。v1の線形的な「1仮説ずつ順番に検証」というボトルネックも解消されている。これは研究者のワークフローを根本的に変える可能性がある。

インストールと実行手順

環境構築

AI Scientist v2はPythonベースで、conda環境での実行が推奨されている。

# リポジトリのクローン

git clone https://github.com/SakanaAI/AI-Scientist-v2.git

cd AI-Scientist-v2

# conda環境の作成とアクティベート

conda create -n ai-scientist-v2 python=3.11 -y

conda activate ai-scientist-v2

# PyTorchのインストール(CUDA対応の場合)

conda install pytorch torchvision torchaudio pytorch-cuda=12.1 -c pytorch -c nvidia

# 依存パッケージのインストール

pip install -r requirements.txt

# APIキーの設定(使用するプロバイダーに応じて)

export OPENAI_API_KEY="sk-your-openai-key"

export GOOGLE_API_KEY="your-google-api-key"

# AWS Bedrock経由でClaudeを使う場合はAWS認証情報を設定

export AWS_ACCESS_KEY_ID="your-access-key"

export AWS_SECRET_ACCESS_KEY="your-secret-key"

export AWS_DEFAULT_REGION="us-east-1"

# Semantic Scholar APIキー(新規性チェック用、推奨)

export S2_API_KEY="your-semantic-scholar-key"

AI Scientist v2はLLM APIを大量に呼び出すため、1回の実験実行で約15〜20ドルのAPI料金が発生する。論文執筆フェーズを含めると合計20〜25ドル。意図しない高額請求を防ぐため、APIプロバイダー側で利用上限を設定しておくことを推奨する。

研究の実行

実行は2ステップで行う。まずIdeation(仮説生成)を実行し、次にメインの研究パイプラインを起動する。

# Step 1: Ideation — 仮説・研究アイデアの生成

python run_ideation.py \

--topic "your research topic description" \

--model gpt-4o \

--num_ideas 5

# Step 2: 研究パイプライン(PATS)の実行

python launch_scientist_bfts.py \

--idea-file ideas/your_topic/ideas.json \

--model gpt-4o \

--num_workers 4 \

--max_steps 50

run_ideation.pyは指定したテーマに基づいて複数の研究仮説を生成し、Semantic Scholar APIで新規性を検証した上でJSON形式で保存する。

launch_scientist_bfts.pyがPATSアルゴリズムの本体で、生成された仮説を木構造で探索・実験・評価する。num_workersで並列実行数を指定でき、複数の仮説を同時に検証することで探索速度を上げられる。max_stepsは探索ステップの上限で、コストと探索の深さのトレードオフを制御する。

実行が完了すると、以下の成果物が出力される。

- LaTeX論文 — Abstract、Introduction、Related Work、Method、Experiments、Conclusionの標準的な学術論文構成

- 実験ログ — 各ノードの実験結果、評価スコア、探索履歴のJSON形式ログ

- 生成コード — 実験に使用したPythonスクリプト一式。再実行可能な形で保存

- データ・グラフ — 実験結果の可視化。論文に埋め込まれるグラフも自動生成

num_workersパラメータは探索の並列度を制御する重要な設定だ。たとえばnum_workers=4に設定すると、4つの仮説を同時並行で実験・評価できる。APIの呼び出し回数は増えるためコストも比例して増加するが、探索速度は大幅に向上する。コストを抑えたい場合はnum_workers=1から始めて、有望なテーマが見つかったら並列度を上げるアプローチが現実的だ。

対応LLMプロバイダーとモデル選択

AI Scientist v2は複数のLLMプロバイダーに対応しており、研究タスクの特性やコストに応じて使い分けられる。

| プロバイダー | 対応モデル例 | 特徴 | API設定 |

|---|---|---|---|

| OpenAI | GPT-4o, o1 | 高品質な推論・コード生成。最も実績が多い | OPENAI_API_KEY |

| Gemini 2.5 Pro, Flash | 長いコンテキスト対応。コスト効率が良い | GOOGLE_API_KEY |

|

| Anthropic (Bedrock) | Claude 3.5 Sonnet, Opus | 緻密な分析と論文執筆に強い | AWS認証情報 |

論文の品質を最大化したい場合はGPT-4oやClaude Opus、コストを抑えたい場合はGemini Flashが推奨される。OpenAIのo1モデルは推論能力が高く、仮説の評価フェーズで特に有効。Claude Codeのベストプラクティスでも触れているが、タスクの性質に応じたモデル選択はAIツール活用の基本だ。

AnthropicのClaudeはAWS Bedrock経由でのアクセスとなる点に注意が必要だ。直接のAnthropic APIではなく、AWSの認証情報(Access Key、Secret Key、Region)を設定する。Bedrock経由にすることで、AWSの既存のセキュリティ・課金管理の仕組みに統合できるメリットがある。企業の研究所でAWS環境が整っている場合は特に導入しやすい構成だ。

Semantic Scholar APIは論文の新規性チェックに使用される。無料で利用可能だが、APIキーを取得しておくとレートリミットが緩和される。既存の学術論文データベースから類似研究を検索し、生成した仮説の新規性を自動判定する。

モデル別の推定コスト

実行コストはモデル選択に大きく依存する。以下は1回のフル実験(Ideation + PATS探索 + 論文執筆)の目安だ。

| モデル | 実験フェーズ | 執筆フェーズ | 合計目安 |

|---|---|---|---|

| GPT-4o | 約15〜20ドル | 約5ドル | 約20〜25ドル |

| Gemini 2.5 Flash | 約5〜10ドル | 約2ドル | 約7〜12ドル |

| Claude Opus (Bedrock) | 約25〜35ドル | 約8ドル | 約33〜43ドル |

コスト重視ならGemini Flash、品質重視ならGPT-4oまたはClaude Opusという使い分けが現実的だ。初回は低コストモデルで動作確認し、有望なテーマが見つかったら高品質モデルに切り替えるアプローチを推奨する。

実用上の制限と注意点

AI Scientist v2は画期的なツールだが、現段階での制限を正しく理解しておく必要がある。本番の論文投稿に使う前に、以下の制約を十分に把握すべきだ。

論文品質のばらつき — AIが生成する論文の品質は一定ではない。ICLR 2025ワークショップでの採択実績はあるものの、すべての出力が学術論文として通用するレベルとは限らない。実験設計の妥当性、統計的検定の正確性、考察の深さは必ず人間が検証すべきだ。

コストの管理 — 1回のフル実行で20〜25ドル程度かかる。探索ステップ数(max_steps)や並列ワーカー数(num_workers)を増やすとコストは比例して増加する。試行錯誤の段階では小さなパラメータから始め、徐々にスケールアップすることを推奨する。

実験環境の制約 — AI Scientist v2が生成する実験コードは、Pythonの科学計算ライブラリ(NumPy、PyTorch等)を前提としている。ウェットラボ実験(生物学・化学の物理的な実験)は対象外だ。計算機科学・機械学習分野の研究が主なターゲットとなる。

再現性の課題 — LLMの出力は確率的であるため、同じテーマで実行しても毎回異なる仮説・実験結果が生成される。研究の再現性を確保するにはシードの固定やログの保存が重要だ。

対象分野の限界 — 現時点でAI Scientist v2が最も効果を発揮するのは、計算機科学・機械学習・統計学など、コンピュータ上で実験が完結する分野だ。生物学のウェットラボ実験、物理学の大型装置実験、社会科学のフィールド調査など、物理的な操作が必要な研究は対象外。ただし、これらの分野でもデータ分析や論文執筆のフェーズでは活用できる可能性がある。

APIの依存関係 — 外部LLM APIへの依存は可用性のリスクとなる。APIのレート制限に引っかかると実験が中断する場合がある。長時間の実験実行では、API側の一時的な障害に対するリトライ機構が重要になる。

AIが生成した論文をそのまま投稿する場合、多くの学術会議・ジャーナルでAI生成コンテンツの開示が求められている。ICML、NeurIPS、ICLRなどの主要会議は2024年以降、AI利用の開示ポリシーを整備している。AI Scientist v2を使用した研究では、論文中にAIツールの使用を明記することが必須と考えるべきだ。最終的な著者としての責任は人間の研究者にあり、AIが出力した内容の正確性・倫理性を保証するのは研究者自身である。

類似ツール・アプローチとの比較

AI Scientist v2の位置づけを、関連するAI研究支援ツールと比較する。

| 比較項目 | AI Scientist v2 | MLAgentBench | ChemCrow | AI Research Assistant (各種) |

|---|---|---|---|---|

| 開発元 | Sakana AI(日本) | Stanford等 | Zurich大等 | 各社 |

| 自律度 | 完全自律(仮説→論文) | 実験実行に特化 | 化学実験の計画支援 | 部分的支援 |

| 対象分野 | CS・ML全般 | ML/ベンチマーク | 化学 | 汎用 |

| テンプレート | 不要(v2) | ベンチマーク定義が必要 | ツール定義が必要 | タスク依存 |

| 論文執筆 | LaTeX自動生成 | なし | なし | なし〜部分的 |

| 探索戦略 | PATS(木構造探索) | 線形 | ReActベース | タスク依存 |

| 学術実績 | ICLR 2025 WS採択 | NeurIPS 2023 | Nature MI 2024 | — |

| コスト/回 | 約20〜25ドル | LLM API依存 | LLM API + ツール依存 | サービス依存 |

| OSS | Apache 2.0 | MIT | MIT | 混在 |

AI Scientist v2の最大の差別化ポイントは、仮説生成から論文執筆までのエンドツーエンドの自動化とPATSによる体系的な探索の2つだ。他のツールは研究プロセスの一部(実験実行、化学計算など)を自動化するが、研究サイクル全体を自律的に回すものはAI Scientist v2以外にほとんど存在しない。

一方で、AIエージェントフレームワークの観点からは、AI Scientist v2は「科学研究」というドメインに高度に特化したエージェントであり、汎用的なエージェントフレームワーク(LangChain、CrewAI等)とは設計哲学が異なる。AIエージェントのアーキテクチャ設計を学ぶ上でも、ドメイン特化型エージェントの優れた事例として参考になる。

コスト効率の観点 — 1回の実験で20〜25ドルというコストは、人間の研究者の時給に換算すれば圧倒的に安い。ポスドク研究者が同等の作業を行うには数日〜数週間かかることを考えると、アイデアの初期スクリーニングやベースライン実験の自動化には十分なROIがある。ただし、品質のばらつきがあるため、最終的な論文としてそのまま使えるとは限らない点は他ツールと同様だ。

想定ユースケースと活用シナリオ

AI Scientist v2はどのような場面で最も効果を発揮するのか。現実的なユースケースを整理する。

アイデアの初期スクリーニング — 研究者が10個の仮説を思いついたとき、そのうちどれが有望かを判断するには予備実験が必要だ。AI Scientist v2に10個すべてを投入し、PATSで自動探索させることで、人間が深掘りすべき2〜3個の有望株を効率的に絞り込める。Claude Codeのベストプラクティスで紹介されているAIとの協業パターンと同様、AIには広く浅い探索を任せ、人間は深い洞察に集中するのが最適な分業だ。

ベースライン実験の自動化 — 新しい手法を提案する論文では、既存手法との比較(ベースライン)が必須。ベースラインの実装と評価は定型作業になりがちで、AI Scientist v2の自動化が特に有効。人間は提案手法の開発に集中し、比較実験はAIに任せるワークフローが考えられる。

サーベイ代替としての活用 — 特定テーマの研究動向を把握したいとき、Ideationフェーズだけを実行してSemantic Scholar APIの検索結果を活用するという使い方もある。網羅的な先行研究の洗い出しが半自動化される。

教育・学習目的 — 研究手法を学んでいる大学院生が、AIが生成した研究プロセスを観察することで「研究の進め方」を学ぶ教材として活用できる。AIの出力を批判的に評価する訓練にもなる。

AI自律研究の未来 — AI Scientist v2が示す方向性

AI Scientist v2は「AIが科学研究を行う」という概念を実証した重要なプロジェクトだ。ICLR 2025ワークショップでの論文採択は、AIが生成した研究成果が一定の学術的品質を満たしうることを示している。

ただし、現時点ではあくまで「ツール」としての位置づけが適切だ。AIが生成した仮説や実験結果を鵜呑みにするのではなく、人間の研究者が批判的に検証し、方向性を修正するプロセスが不可欠。AI Scientist v2の真価は「研究者の生産性を10倍にする」ことであり、「研究者を不要にする」ことではない。

人間が全工程を手動"] --> B["AI Scientist v1

テンプレート + 部分自動化"] B --> C["AI Scientist v2

テンプレート不要

PATS探索で全自動"] C --> D["将来の展望

マルチモーダル実験

物理実験のロボット連携"] style C fill:#e8f5e9,stroke:#4CAF50

今後の発展として、以下の方向性が考えられる。

- マルチモーダル実験 — テキストだけでなく、画像・音声・動画データを扱う実験の自動化。コンピュータビジョンや音声認識分野への展開

- 物理実験との連携 — ロボティクスや自動化装置と組み合わせ、ウェットラボ実験もループに含める構想。製薬や材料科学分野での活用

- マルチエージェント協調 — 複数のAI Scientistが異なるアプローチで同じテーマに取り組み、結果を統合する仕組み

- コミュニティ貢献 — Apache 2.0ライセンスにより、研究コミュニティがPATSアルゴリズムを改良・拡張する余地がある

Sakana AIは東京を拠点に、進化的アルゴリズムとAIの融合を研究テーマとしている。AI Scientist v2のPATSアルゴリズムにも、探索空間を効率的に最適化するという進化計算的な発想が反映されている。日本発のAI研究成果として、今後のアップデートにも注目したい。

GitHub Star数5,500、Apache 2.0ライセンス、ICLR採択という実績。科学研究の効率化を目指す研究者にとって、AI Scientist v2は今すぐ試す価値のあるツールだ。まずは小さなテーマでrun_ideation.pyを走らせてみることから始めてほしい。AIが生成する「研究の原石」がどの程度のものか、自分の目で確かめるのが最良の第一歩だ。

AI Scientist v2 を実運用に乗せる前の判断材料

「AI Scientist v2でNeurIPS級の論文が自動生成できる」という見出しに惹かれる読者は多いが、実プロジェクトに導入する前に押さえておくべき制約を3つ整理した。

| 評価軸 | 公式の謳い文句 | 実運用での留意点 |

|---|---|---|

| 仮説立案の独自性 | 既存研究のギャップを自律的に発見 | LLMの訓練データ範囲外のテーマでは陳腐な仮説に偏る |

| 実験の再現性 | Progressive Agentic Tree Searchで自律探索 | seed固定・GPU指定をスクリプト側で明示しないと結果がブレる |

| 論文の査読適合性 | 自動でLaTeXフォーマットへ変換 | 査読者対応(rebuttal)は人手が必要、AIだけで完結しない |

最も実用度が高いのは「リサーチの初期スキャフォールディング」だ。実装→実験→草案までの一次素材生成にAI Scientist v2を使い、最終仕上げは研究者が担う形が現状の最適解。Sakana AIの公式デモ動画でも、最終的な論文採択前に人間チェックが入っている点は明示されている。

Claude Scholarの研究フロー組み込みパターン と組み合わせれば、執筆フェーズと研究実装フェーズで使い分けられる。